Long Short Term Memory (LSTM)

解説:記憶を「ベルトコンベア」で運ぶ

Long Short Term Memory(LSTM)は、RNNが抱えていた「昔のことをすぐに忘れてしまう(長期依存の学習が苦手)」という致命的な弱点を克服したモデルです。

通常のRNNは、情報が通過するたびに計算(掛け算)が繰り返されるため、古い記憶がどんどん薄れて消えてしまいます(勾配消失問題)。

そこでLSTMは、情報の通り道に「邪魔されずに記憶を運ぶ専用レーン(セル状態)」を用意しました。

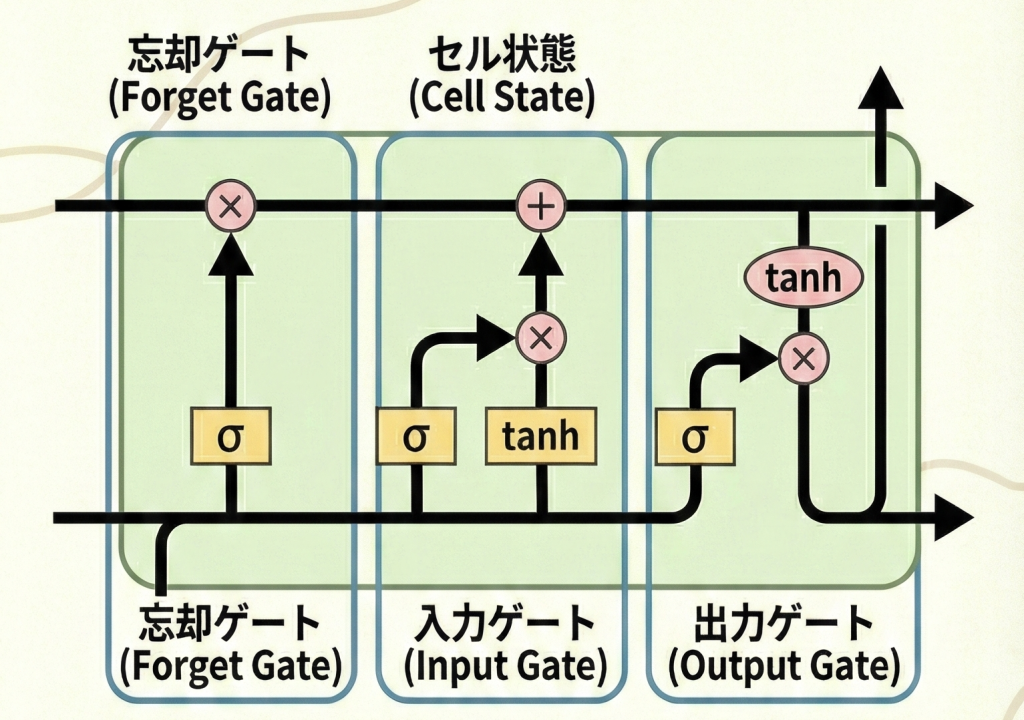

記憶を制御する「3つのゲート」

LSTMの内部には、情報をただ通すだけでなく、「何を忘れて、何を覚えるか」を調整する3つの関所(ゲート)があります。

| ゲート名 | 役割とセリフ |

|---|---|

| 忘却ゲート (Forget Gate) |

「いらない過去を捨てる」 過去の記憶(セル状態)の中から、もう役に立たない情報を削除します。 (例:「昨日の天気」の情報は、今日の服装選びにはもう不要だから消そう) |

| 入力ゲート (Input Gate) |

「新しい情報を書き込む」 今の新しい入力情報のうち、どれを重要として記憶(セル状態)に追加するかを決めます。 (例:「今日の天気」は重要だからしっかりメモしておこう) |

| 出力ゲート (Output Gate) |

「結果を出力する」 更新された記憶と今の入力を元に、最終的に次の層へ渡す値(隠れ状態)を決定します。 |

💡 G検定の隠れキーワード:「CEC」

LSTMの中心にある「記憶を保持する部品」のことを、専門的にはCEC(Constant Error Carousel:定誤差カルーセル)と呼びます。

「勾配消失を防ぐための中心的な機能は何か?」と聞かれたら、このCECが正解です。

LSTMの中心にある「記憶を保持する部品」のことを、専門的にはCEC(Constant Error Carousel:定誤差カルーセル)と呼びます。

「勾配消失を防ぐための中心的な機能は何か?」と聞かれたら、このCECが正解です。

G検定対策

出題ポイント

- 構造:「忘却・入力・出力」の3つのゲートと、記憶を保持するセル状態(Cell State)を持つ。

- 効果:「勾配消失問題」を解決し、長い時系列データ(長文の翻訳や音声認識)の学習を可能にした。

- CEC:勾配を消失させずに維持する中心的な役割を持つ部分の名称。

ひっかけ対策

- × LSTMはRNNより計算量が少ない

(解説)ゲートなどの複雑な機構が増えた分、パラメータ数は通常のRNNの約4倍になり、計算コストも増えています。 - × ゲートは2つである

(解説)LSTMは3つです。「ゲートが2つ(忘却ゲートがない)」なのは、LSTMを簡略化したGRU(Gated Recurrent Unit)という別のモデルです。

📚 より詳細を学びたい方へ