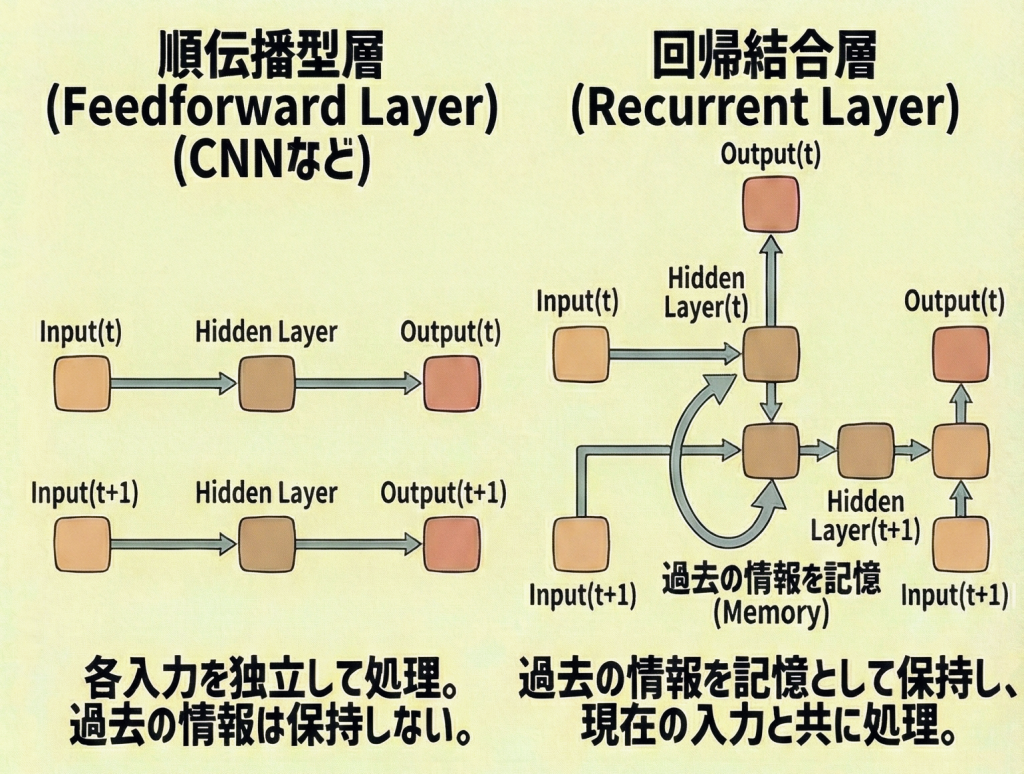

回帰結合層(Recurrent Layer)

解説:自分にパスを出す「記憶」の仕組み

回帰結合層は、ニューラルネットワークの中に「ループ(繰り返し)構造」を持たせた層のことです。最大の特徴は、計算した出力をそのまま外に出すだけでなく、「次の瞬間の自分自身」にも入力として戻す点です。

これを人間の作業に例えると、「前回のメモを見ながら、今の作業をする」ことに似ています。

🔄 順伝播型(FNN/CNN)との違い

- 順伝播型(一方通行):

入力されたデータを処理したら終わり。「その瞬間」のことしか考えません。

(例:この写真は猫だ! → 終了) - 回帰結合層(ループ型):

1ステップ前の自分の状態(隠れ状態)を受け取ります。つまり「過去の記憶」を持った状態で、今のデータを処理します。

(例:さっき「私は」と言ったから…次は「猫だ」と言う確率が高いな)

なぜ「時系列データ」に強いのか?

音声、文章、株価、動画などのデータは、「順番」に意味があります。

「私」「は」「猫」「です」という単語をバラバラにして「猫」「私」「です」「は」と並べ替えると、意味が通じなくなります。

回帰結合層は、前のデータを受け取って次の処理を行うため、こうした「前後の文脈(コンテキスト)」を考慮しなければならないデータの処理に最適です。

| 層の種類 | 得意なデータ | キーワード |

|---|---|---|

| 畳み込み層 (CNN) |

画像(空間的な特徴) | 「形」を見る |

| 回帰結合層 (RNN) |

時系列(時間的な特徴) | 「流れ」を見る |

G検定対策

出題ポイント

- 構造:出力を次の入力に戻す「再帰(リカレント)構造」を持つ。

- 役割:過去の情報を「隠れ状態(内部状態)」として保持し、時系列データ(可変長の系列データ)を処理可能にする。

- 用途:自然言語処理(翻訳、文章生成)、音声認識、株価予測など。

ひっかけ対策

- × 画像の空間的な特徴を捉えるのに適している

(解説)それは「畳み込み層」の説明です。回帰結合層は「時間的な流れ」を捉えます。 - × 過去の情報を永久に保持できる

(解説)単純な回帰結合層では、時間が経つにつれて情報が消えてしまう「勾配消失問題」が発生します。(これを解決するのがLSTMです)。

📚 より詳細を学びたい方へ