勾配降下法(Gradient Descent)

解説:目隠しで「谷底」を目指す

勾配降下法は、ニューラルネットワークが「誤差(損失)」を最小にするパラメータ(重み)を見つけるための最適化アルゴリズムです。

AIの学習は、よく「真っ暗闇の山で、一番低い谷底(誤差最小点)を探す」ことに例えられます。

周りは見えませんが、足元の地面の「傾き(勾配)」だけは分かります。そこで、「傾いている方向と逆(下り坂)に一歩進む」ことを繰り返せば、いつかは谷底にたどり着けるはずです。これが勾配降下法の基本的な考え方です。

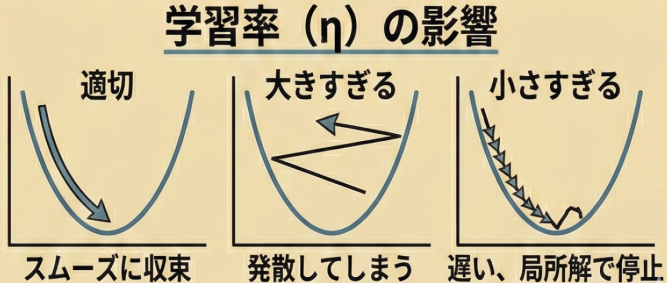

重要な要素:学習率(Learning Rate)

このとき、「一歩の大きさ」を決めるのが「学習率(イータ:η)」です。この設定が学習の成否を分けます。

| 学習率の設定 | どうなる?(メリット・デメリット) |

|---|---|

| 大きすぎる (大股で歩く) |

谷底を飛び越えてしまい、行ったり来たりを繰り返す(発散する)。 いつまで経っても収束しない。 |

| 小さすぎる (小股で歩く) |

慎重すぎて、谷底に着くまでに膨大な時間がかかる。 また、本当の谷底ではない「小さなくぼみ(局所最適解)」にハマって抜け出せなくなるリスクがある。 |

| 適切 | スムーズに谷底(大域最適解)へ到達できる。 |

G検定対策

出題ポイント

- 目的:誤差関数を「最小化」するパラメータを見つけること。

- 学習率(Learning Rate):人間が決める必要がある「ハイパーパラメータ」であり、この調整が非常に重要。

- 課題:勾配が0になると更新が止まるため、本当の最小値ではない場所で止まる「局所最適解(Local Optima)」や、平坦な場所「鞍点(Saddle Point)」の問題がある。

ひっかけ対策

- × 必ず最適な解(大域最適解)が見つかる

(解説)誤りです。途中のくぼみ(局所最適解)にハマって終わる可能性があります。これを防ぐために、確率的勾配降下法(SGD)などが使われます。 - × 誤差を最大化する

(解説)誤りです。それは「勾配上昇法」です。ニューラルネットワークの学習は「誤差の最小化(降下)」です。