AIと民主主義:情報の偏りと分断

解説:心地よい「泡」の中で失われる対話

民主主義が健全に機能するためには、有権者が多様な情報に触れ、異なる意見を持つ人々と議論し、合意を形成することが不可欠です。

しかし、AIによる「パーソナライズ(最適化)」技術は、ユーザーが「見たい情報」や「信じたい意見」ばかりを優先的に表示することで、意図せず社会の分断(ポラライゼーション)を加速させてしまう副作用を持っています。

1. 2つの重要キーワード

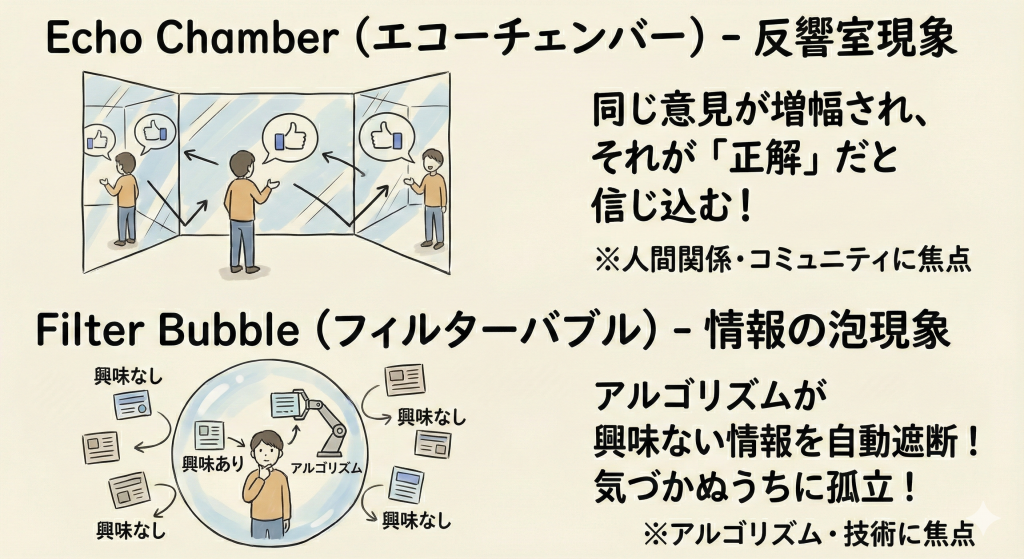

どちらも「偏った情報しか見えなくなる」現象ですが、発生のメカニズムに違いがあります。

| 用語 | 意味とメカニズム | イメージ |

|---|---|---|

| エコーチェンバー (Echo Chamber) |

「反響室」現象。 SNSなどで自分と似た意見の人ばかりフォローし、閉じたコミュニティ内で同じような意見が行き交うことで、「自分の意見こそが世の中の正解だ」と信じ込んでしまう現象。 (※人間関係やコミュニティの性質に焦点がある) |

鏡張りの部屋で自分の声だけが反響して増幅される様子。 |

| フィルターバブル (Filter Bubble) |

「情報の泡」に閉じ込められる現象。 検索エンジンやSNSのアルゴリズムが、ユーザーの過去の行動(クリック履歴など)を学習し、興味のない情報を自動的に遮断(フィルタリング)してしまうこと。 本人が気づかないうちに情報が選別されている点が恐ろしい。 (※アルゴリズムの技術的な作用に焦点がある) |

透明な泡の中に隔離され、外の世界が見えなくなっている様子。 |

2. 民主主義への影響

これらの現象が組み合わさることで、以下のような問題が発生します。

政治的分極化 (Political Polarization)

右派は右派の情報だけ、左派は左派の情報だけを浴び続けることで、思想が先鋭化・過激化します。「相手側の意見」を目にする機会が失われるため、対立するグループへの敵対心が増幅し、社会的な合意形成が困難になります。

確証バイアスの強化

人間にはもともと「自分に都合の良い情報だけを集め、反証を無視する」という心理的傾向(確証バイアス)があります。

AIのレコメンド機能は、この人間の弱点をテクノロジーで極限まで増幅させてしまいます。

マイクロターゲティングと選挙介入

個人の性格や政治的志向をAIで精密に分析し、その人に「刺さる」広告だけを狙い撃ちで表示する手法です。

ケンブリッジ・アナリティカ事件 (2018年)

Facebookから流出した数千万人分の個人データを不正利用し、AIで有権者の心理を分析。2016年の米大統領選やブレグジット(英国のEU離脱)投票において、投票行動を操作しようとしたとされる事件。

「AIによる民主主義へのハッキング」として世界に衝撃を与えた。

Facebookから流出した数千万人分の個人データを不正利用し、AIで有権者の心理を分析。2016年の米大統領選やブレグジット(英国のEU離脱)投票において、投票行動を操作しようとしたとされる事件。

「AIによる民主主義へのハッキング」として世界に衝撃を与えた。

G検定対策

出題ポイント

- フィルターバブルの提唱者: イーライ・パリサー (Eli Pariser)。「インターネットが何を見せるかを勝手に決めている」と警鐘を鳴らした。

- エコーチェンバーの影響: 異論が排除され、コミュニティ内の意見が過激化(先鋭化)する。

- 解決策のキーワード:

- セレンディピティ (Serendipity): 「偶然の幸運な出会い」。自分の好みとは違う意外な情報にあえて出会わせるようなアルゴリズム設計が求められている。

ひっかけ対策

- × フィルターバブルは、ユーザーが自分で意図的に情報を遮断することである

(解説)ユーザーの意図ではなく、アルゴリズムが勝手に(自動的に)行う点がフィルターバブルの本質です。ユーザーは遮断されていることに気づきにくいのが特徴です。 - × AIによるパーソナライズ機能は、常にユーザーにとって有益である

(解説)利便性は高いですが、「視野狭窄(トンネル・ビジョン)」を引き起こすリスクと表裏一体です。

📚 より詳細を学びたい方へ