透明性と説明可能性 (XAI)

解説:AIは「ブラックボックス」である

ディープラーニングなどの高度なAIモデルは、内部で何億回もの複雑な計算を行っているため、開発者ですら「なぜAIがその答えを出したのか」を論理的に説明できないことがあります。これをAIの「ブラックボックス性」と呼びます。

しかし、医療診断や融資審査など、人生を左右する場面で「理由は分からないけど、AIがダメと言ったのでダメです」では社会的に通用しません。

そこで求められるのが、AIの判断プロセスを人間が理解できるようにする「説明可能性(Explainability)」や、その技術である「XAI (Explainable AI)」です。

1. なぜ説明が必要なのか?(根拠と対象)

説明を求める相手(ステークホルダー)によって、必要な「理由」は異なります。

| 対象者 | 説明が必要な理由 | 求める内容 |

|---|---|---|

| エンドユーザー (一般利用者) |

納得感・信頼・権利 「なぜローンが落ちたのか?」「差別されていないか?」を知る権利がある(GDPRなど)。 |

「年収が基準より50万円低かったからです」といった、自分の行動に結びつく理由。 |

| 開発者 (エンジニア) |

デバッグ・改善 AIが間違えた時、どこを直せばいいか特定するため。 |

「特定の特徴量に過剰反応している」「ノイズを誤学習している」といった技術的な詳細。 |

| 規制当局・監査人 | アカウンタビリティ(説明責任) 法律や倫理規定を守っているか証明するため。 |

モデル全体の挙動が公平であることの統計的根拠。 |

2. 精度と説明性のトレードオフ

一般的に、AIモデルには以下のジレンマが存在します。

- ホワイトボックスなモデル: 線形回帰や決定木。

中身がシンプルで説明しやすいが、複雑な予測(画像認識など)は苦手で精度が低い。 - ブラックボックスなモデル: ディープラーニングやアンサンブル学習。

精度は極めて高いが、中身が複雑怪奇で説明が困難。

この「精度の高いモデル」を、いかにして説明可能にするかがXAIの研究テーマです。

3. 代表的な説明技術 (XAI)

ブラックボックスなモデルを「後付け」で解釈するための技術です。以下の名称と特徴はG検定頻出です。

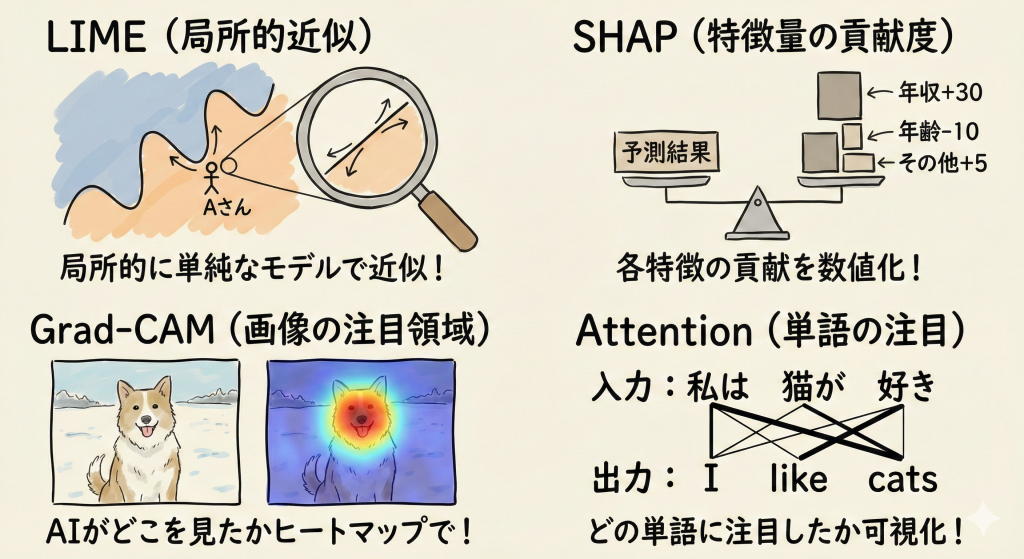

LIME (Local Interpretable Model-agnostic Explanations)

「局所的」な説明技術。

モデル全体を説明するのは諦めて、「ある特定の入力データ(例:Aさんの審査)」の周辺だけを、単純なモデル(線形モデルなど)で近似して説明する方法です。

- 仕組み: 入力データを少し変化させたサンプルを大量に作り、結果がどう変わるかを観察します。「年収を少し下げたら審査に落ちた」→「じゃあ年収が重要なんだね」と推測します。

SHAP (SHapley Additive exPlanations)

ゲーム理論(シャープレイ値)を応用した手法。

予測結果に対して、各特徴量が「どれくらい貢献したか(プラスやマイナスの影響力)」を算出します。

- 特徴: LIMEよりも理論的に厳密で、一貫性があります。「年収が+30点、年齢が-10点の影響を与えた」のように数値化できます。

Grad-CAM (Gradient-weighted Class Activation Mapping)

画像認識(CNN)専用の技術。

AIが画像の「どこを見て」判断したのかをヒートマップ(赤〜青の色)で可視化します。

- 例: 「犬」と判断した画像の、犬の「顔」の部分が赤くなっていれば、AIは正しく特徴を捉えていると分かります。逆に背景の「雪」を見ていたら、誤学習していると分かります。

Attention (アテンション) の可視化

自然言語処理(翻訳など)で使われる技術。

翻訳する際、入力文の「どの単語」に注目(Attention)して訳語を決めたかを可視化します。

G検定対策

出題ポイント

- GDPR(EU一般データ保護規則): 「プロファイリングを含む自動化された意思決定について、その論理に関する意味のある情報を得る権利(説明を求める権利)」が明記されている。

- XAIの手法:

- LIME: 入力を摂動(少し変化)させて、局所的に線形近似する。

- SHAP: ゲーム理論のシャープレイ値を用いて、特徴量の寄与度を計算する。

- Grad-CAM: CNNの判断根拠をヒートマップで可視化する。

- トレードオフ: 「一般に、モデルの表現力(精度)が高いほど、解釈性(説明可能性)は低くなる傾向がある」という原則。

ひっかけ対策

- × 説明可能性が高ければ、必ず公平なモデルである

(解説)「なぜ差別したか」が説明できたとしても、差別していることには変わりありません。説明可能性は、不公平を発見するための手段に過ぎません。 - × 決定木はブラックボックスモデルである

(解説)決定木は「もしAならB」というルールの分岐が見えるため、代表的なホワイトボックスモデル(説明容易なモデル)です。

📚 より詳細を学びたい方へ