Multi-Head Attention(多頭注意機構)

解説:「三人寄れば文殊の知恵」をAIで実現

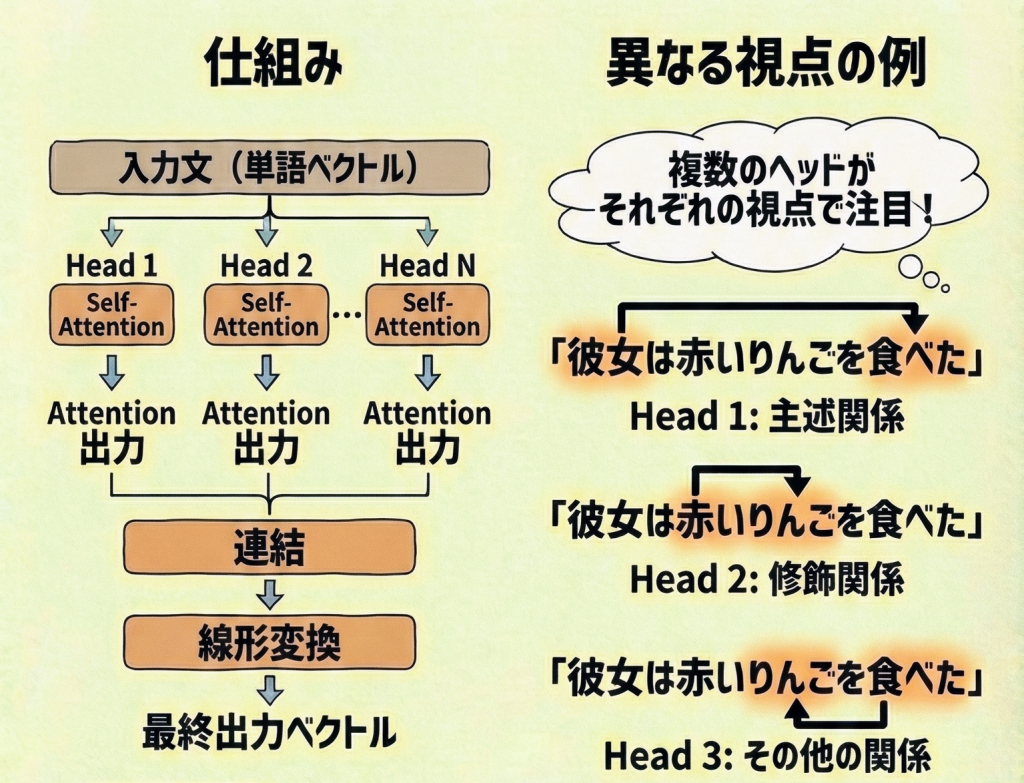

Multi-Head Attention(マルチヘッド・アテンション)は、Self-Attentionの計算を一つだけでなく、複数の「ヘッド(Head)」に分割して、同時並行で行う仕組みです。

一つのAttention(シングルヘッド)だけだと、どうしても「特定の関係性(例:単語の隣接関係)」だけに注目が偏ってしまい、他の重要な情報を見落とす可能性があります。

そこで、AIに「複数の人格(視点)」を持たせることにしました。

🕵️♀️ 複数のヘッドによるチームプレー例えば「8つのヘッド」がある場合、それぞれが違う役割を持って文章を読み解きます。

- ヘッドA:「誰が何をしたか」という主語・述語の関係に注目する。

- ヘッドB:「いつ、どこで」という時制や場所に注目する。

- ヘッドC:「それ」が何を指すかという代名詞の参照に注目する。

- …

最後に、これら全員の分析結果をガチャンと結合(Concat)します。これにより、多角的で深い意味理解が可能になります。

アンサンブル学習のような効果

この仕組みは、機械学習における「アンサンブル学習(複数のモデルの意見を統合して精度を上げる手法)」と似た効果を、一つのモデル内で実現していると言えます。

| 比較 | Single-Head Attention | Multi-Head Attention |

|---|---|---|

| 視点 | 1つの視点のみ。 (複雑な文脈を取りこぼしやすい) |

多角的な視点。 (文法、意味、文脈を同時に捉える) |

| 処理 | 単一の行列計算。 | 分割して並列計算し、最後に連結(Concat)する。 |

G検定対策

出題ポイント

- 構造:Q・K・Vをいくつかのヘッドに分割し、それぞれ独立してAttentionを計算した後、それらを結合(Concatenate)して線形変換する。

- 目的:異なる部分空間(視点)の情報を同時に抽出することで、モデルの「表現力」を向上させる。

- 並列性:分割して計算するため、GPUでの並列処理と相性が良い。

ひっかけ対策

- × 計算量を削減するために導入された

(解説)目的は「精度の向上(表現力を豊かにすること)」です。計算量自体はシングルヘッドと(分割しているため)大きくは変わりませんが、削減が主目的ではありません。 - × 全てのヘッドは同じ重みを共有する

(解説)それぞれのヘッドは独立した異なる重みを持ちます。だからこそ、異なる特徴を学習できるのです。

📚 より詳細を学びたい方へ