Gated Recurrent Unit (GRU)

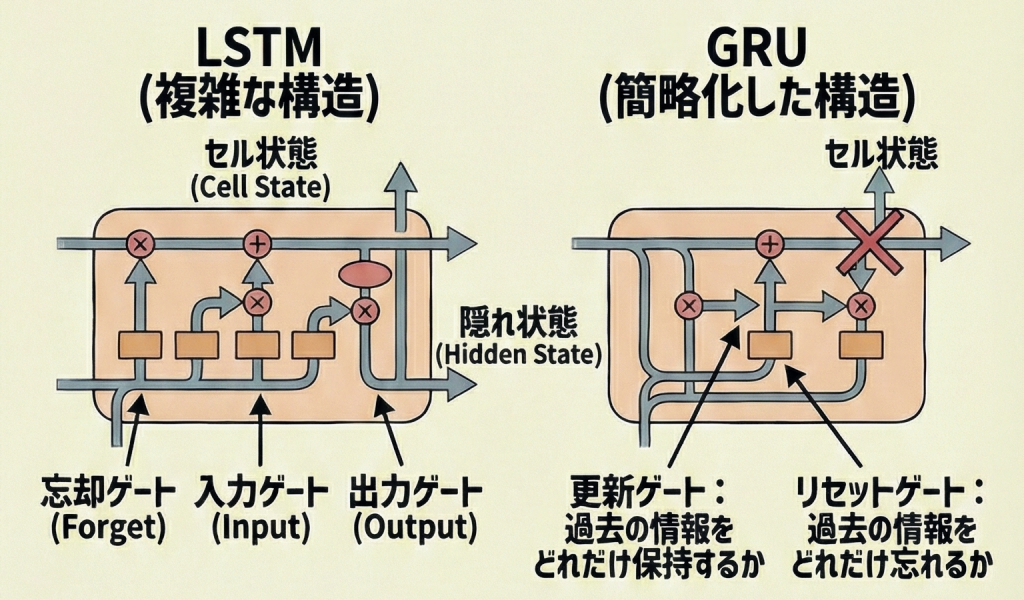

解説:LSTMを「断捨離」して高速化したモデル

Gated Recurrent Unit(GRU)は、2014年に提案された、LSTMの改良版モデルです。

LSTMは非常に高性能でしたが、構造が複雑で計算に時間がかかるという欠点がありました。GRUは、LSTMの性能を保ちつつ、構造をシンプルにすることで「計算速度の向上」と「パラメータ数の削減」を実現しました。

LSTM vs GRU 比較表

| 比較項目 | LSTM (兄) | GRU (弟) |

|---|---|---|

| ゲート数 | 3つ (入力・忘却・出力) |

2つ (更新・リセット) |

| 状態変数 | 2本 (セル状態 + 隠れ状態) |

1本 (隠れ状態のみ) |

| 計算コスト | 重い(パラメータ多い) | 軽い(パラメータ少ない) → 学習が速い |

| 適した場面 | 大規模データ、非常に複雑なタスク | 中小規模データ、計算リソース節約時 |

G検定対策

出題ポイント

- 構造の特徴:「LSTMを簡略化したもの」であり、ゲートが「更新ゲート・リセットゲート」の2つしかないこと。

- 変数の違い:LSTMにあった「セル状態(Cell State)」が存在しないこと。

- メリット:パラメータ数が少ないため、計算量が少なく、データセットが小さくても過学習しにくい(収束が速い)。

ひっかけ対策

- × GRUには忘却ゲートがある

(解説)忘却ゲートの機能は「更新ゲート」の中に組み込まれました。名称として存在するのはLSTMです。 - × GRUはLSTMより精度が常に低い

(解説)タスクによってはLSTMと同等か、それ以上の性能を出すことも多いです。「簡易版だから低性能」という思い込みは捨てましょう。

📚 より詳細を学びたい方へ