連鎖律 (Chain Rule)

解説

連鎖律(チェインルール)とは、複数の関数が入れ子になった「合成関数」を微分するための数学公式です。ディープラーニングの学習(誤差逆伝播法)において、「出力層の誤差を、入力層に向かって逆順に伝えていく」ための核心となるルールです。

「歯車」でイメージする影響力の連鎖

連鎖律は、複数の歯車が連動している様子をイメージすると直感的に分かります。

- 歯車A(入力):これを「1回転」させると、歯車Bが「2回転」する(変化率=2)。

- 歯車B(中間):これを「1回転」させると、歯車Cが「3回転」する(変化率=3)。

- 歯車C(出力):では、「歯車Aを回したとき、歯車Cは何回転するか?」

答えは足し算(2+3=5)ではなく、掛け算(2×3=6回転)になります。

数式で書くと、以下のようになります。

∂C/∂A = ∂C/∂B × ∂B/∂A

つまり、「全体(A→C)の変化率」は、「個々のステップ(A→B、B→C)の変化率」を掛け合わせる(積をとる)ことで求められます。

ニューラルネットワークでの役割

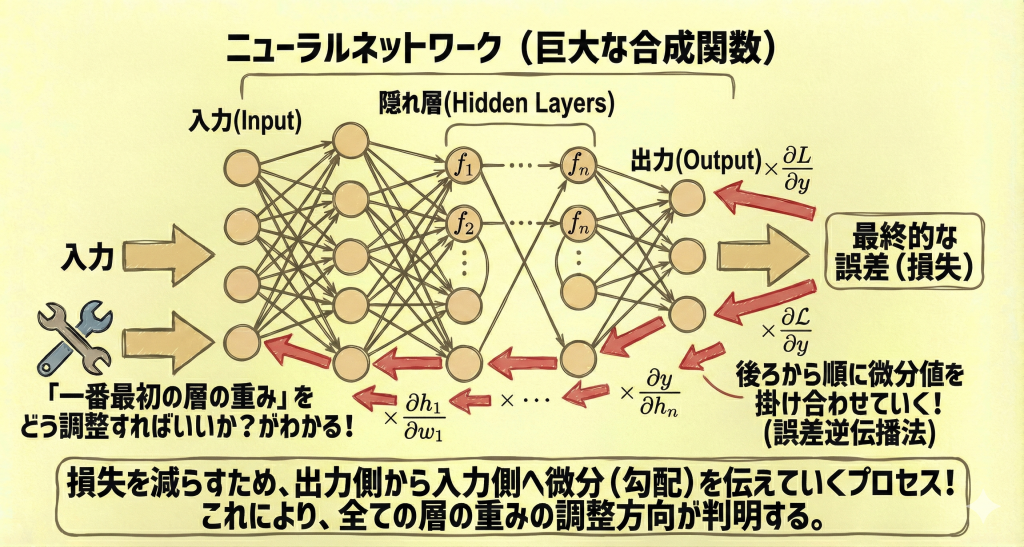

ニューラルネットワークは、何層もの関数が重なった「巨大な合成関数」です。

「最終的な誤差(損失)」を減らすために、「一番最初の層の重み」をどう調整すればいいか? これを知るために、後ろの層から順番に微分値を掛け合わせていくプロセスこそが誤差逆伝播法です。

G検定対策

出題ポイント

- 定義:合成関数の微分を求める公式。個々の関数の微分の「積(掛け算)」で表される。

- 応用:「誤差逆伝播法」は、連鎖律そのものをアルゴリズム化したものである。

よくあるひっかけ問題

- × 連鎖律は、各層の微分値を「足し算(和)」することで全体の勾配を求める

(解説)最大のひっかけポイントです。「掛け算(積)」が正解です。だからこそ、1より小さい値を掛け続けると消えてしまう「勾配消失問題」が発生するのです。 - × 連鎖律は、ニューラルネットワークの「順伝播」の計算に使われる

(解説)誤りです。順伝播はただの計算(代入)です。連鎖律が必要になるのは、微分を行う「逆伝播(バックプロパゲーション)」の時です。

📚 より詳細を学びたい方へ