誤差逆伝播法(バックプロパゲーション)

解説:ミスの原因を「逆流」して探す

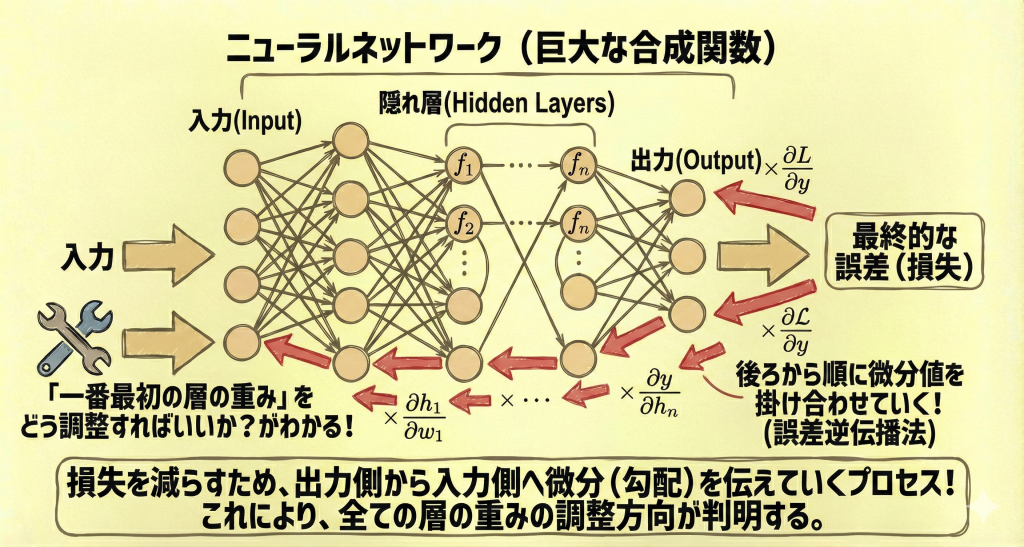

誤差逆伝播法(Backpropagation)は、ニューラルネットワークを学習させるための最も基本的なアルゴリズムです。一言で言えば、「結果のミス(誤差)を逆算して、誰のせいで間違えたのかを特定する手順」です。

AIの学習は、以下の4ステップの繰り返しで行われます。

学習の4ステップ(ここが重要!)

- 順伝播(Forward):

入力層から出力層へデータを流し、AIが「予測」を行う。

(例:「これは猫だ!」) - 誤差計算:

正解と比較して「どれくらい間違えたか(誤差)」を計算する。

(例:「正解は犬だった…誤差大!」) - 逆伝播(Backward):★ここが誤差逆伝播法

誤差を出力層から入力層へ「逆方向」に流し、「どこの重みを調整すれば正解に近づくか(勾配)」を計算する。

(例:「最後の層は悪くない、その前の層の判断ミスだ!」と責任を割り振る) - パラメータ更新:

計算された勾配をもとに、重みを少しだけ修正する(勾配降下法など)。

なぜ「逆」なのか?(信用割当問題)

多層のネットワークでは、最終的な結果が出たとき、「途中のどのニューロンが貢献して、どれが足を引っ張ったのか」が分かりにくくなります(これを信用割当問題と呼びます)。

これを解決するために、ゴール(出力)からスタート(入力)に向かって、「連鎖律(チェインルール)」という微分の公式を使って少しずつ原因を遡っていく手法が開発されました。これが誤差逆伝播法であり、ディープラーニング発展の最大の立役者です。

G検定対策

出題ポイント

- 方向:「出力層 → 入力層」へ、誤差情報を逆向きに伝える。

- 数学的根拠:微分の「連鎖律(チェインルール)」を利用している。

- 役割:各パラメータの「勾配(傾き)」を効率よく計算すること。(※実際に重みを更新するのは「勾配降下法(SGDなど)」の役割ですが、セットで扱われることが多いです)

- 歴史的意義:「信用割当問題(Credit Assignment Problem)」を解決した手法として問われることがある。

ひっかけ対策

- × 入力層から出力層へ学習する

(解説)誤りです。それは「予測(順伝播)」の向きです。学習(修正)は「逆」です。 - × すべての重みをランダムに更新する

(解説)誤りです。ランダムではなく、計算された「勾配(誤差を減らす方向)」に従って更新します。

📚 より詳細を学びたい方へ