カルバック・ライブラー情報量 (KL Divergence)

解説

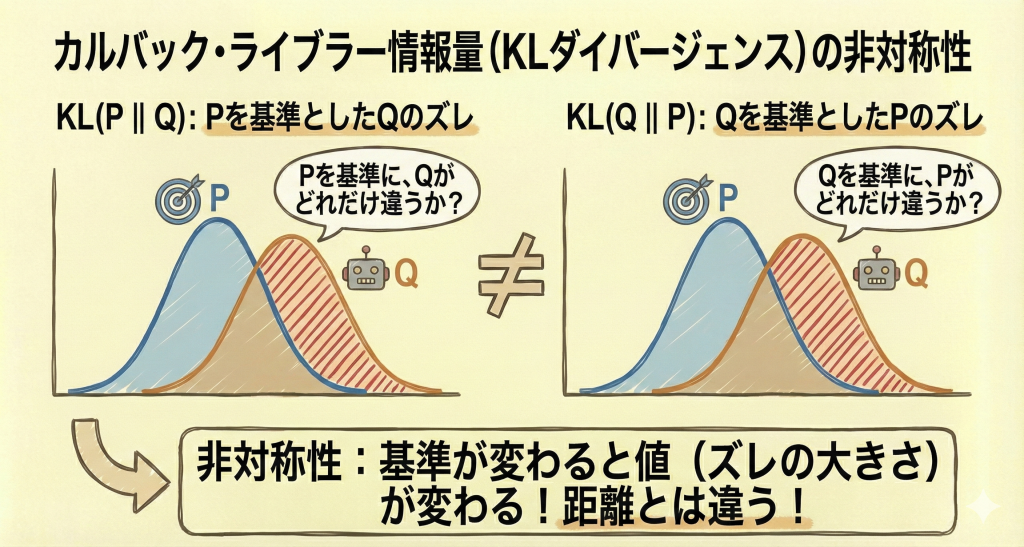

カルバック・ライブラー情報量(KLダイバージェンス)とは、2つの確率分布(例えば「真のデータ分布 P」と「AIが予測した分布 Q」)が、互いにどれくらい似ていないか(情報のズレ)を測る指標です。

「距離」のようで「距離」ではない

KLダイバージェンスは、直感的には「分布間の距離」のようなものですが、数学的な厳密な意味での「距離」ではありません。最大の理由は「一方通行(非対称)」だからです。

- 通常の距離:東京から大阪への距離と、大阪から東京への距離は同じ(対称性)。

- KLダイバージェンス:分布 P から見た Q のズレと、分布 Q から見た P のズレは一致しません(DKL(P||Q) ≠ DKL(Q||P))。

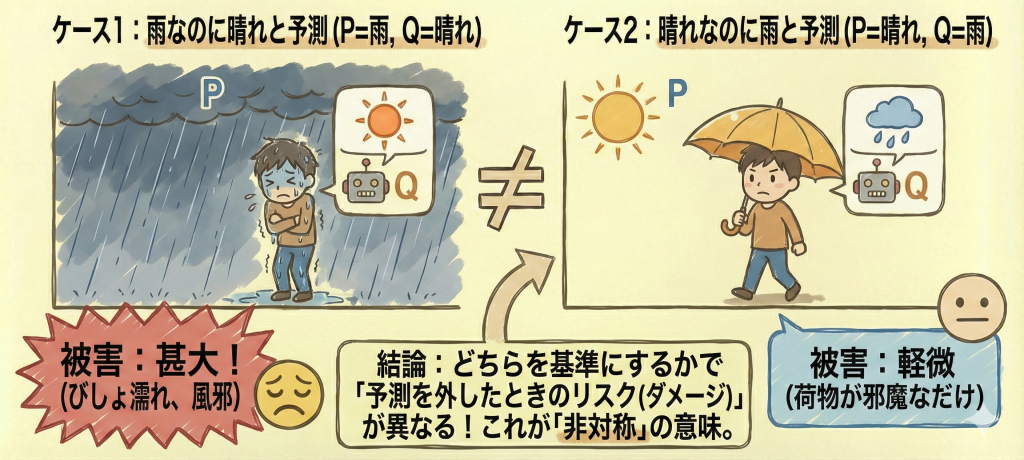

どこが「非対称」なのかというと、「雨なのに晴れと間違える(ケース1)」のと、「晴れなのに雨と間違える(ケース2)」のでは、「予測を外したときのリスク(ダメージ)」が異なることをイメージすると分かりやすいでしょう。

そのため、「距離(Distance)」ではなく「分岐・相違(Divergence)」という言葉が使われます。

交差エントロピーとの関係

機械学習(特に分類問題)では、損失関数として「交差エントロピー」を使いますが、これは実は「KLダイバージェンスを最小化している」ことと同じです。以下の関係式が成り立ちます。

交差エントロピー = エントロピー + KLダイバージェンス

ここで、「エントロピー(真のデータの不確実性)」は定数(変化しない値)なので、「交差エントロピーを最小化する」ことは、「KLダイバージェンス(分布のズレ)を最小化する」ことと数学的に同義になります。

G検定対策

出題ポイント

- 定義:2つの確率分布 P と Q の「近さ(情報の損失量)」を測る尺度。

- 性質:常に0以上の値をとる(分布が完全に一致した時だけ0になる)。

- 関係式:「交差エントロピー - エントロピー = KLダイバージェンス」という式変形が問われることがある。

よくあるひっかけ問題

- × KLダイバージェンスは、数学的な距離の公理(対称性・三角不等式)を満たす

(解説)満たしません。特に「非対称(入れ替えると値が変わる)」である点が最大の特徴であり、ひっかけポイントです。 - × 計算結果がマイナスになることがある

(解説)なりません。情報の「ズレ」を表す量なので、最小値は0(一致)であり、常に非負(プラスまたは0)の値をとります。

📚 より詳細を学びたい方へ