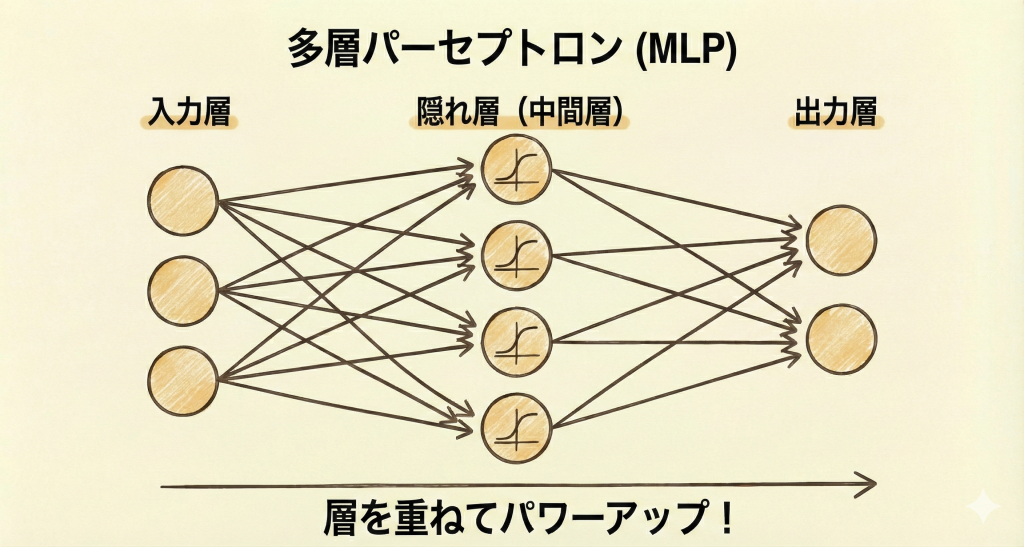

多層パーセプトロン(MLP)

解説:単純パーセプトロンの進化形

多層パーセプトロン(MLP: Multi-Layer Perceptron)は、その名の通り、単純パーセプトロンを何層にも重ねてパワーアップさせたニューラルネットワークです。

最大の特徴は、入力層と出力層の間に「隠れ層(中間層)」を持っていることです。この隠れ層があるおかげで、単純パーセプトロンでは絶対に解けなかった「XOR問題(排他的論理和)」などの複雑な問題を解けるようになり、第2次AIブームを牽引しました。

| 比較項目 | 単純パーセプトロン | 多層パーセプトロン (MLP) |

|---|---|---|

| 構造 | 入力層 → 出力層 (2層のみ) |

入力層 → 隠れ層 → 出力層 (3層以上) |

| 能力 | 線形分離のみ (直線を1本引くだけ) |

非線形分離が可能 (ぐにゃぐにゃした境界線を引ける) |

| 解ける問題 | AND, OR | AND, OR, XOR (排他的論理和) |

なぜ「XOR」が解けるのか?(重要)

単に層を増やしただけでは意味がありません。隠れ層で「非線形活性化関数(シグモイド関数やReLU関数など)」を使うことが絶対条件です。

これにより、直線しか引けなかったグラフ上で「曲線を引く(空間を歪める)」ことができるようになり、白と黒が複雑に入り組んだデータでも綺麗に分けられるようになります。

G検定対策

出題ポイント

- 構造の定義:「入力層、隠れ層(中間層)、出力層」から成るネットワークであること。

- 歴史的意義:単純パーセプトロンの課題であった「XOR問題」を解決し、AI冬の時代を終わらせた。

- 学習方法:一般的に「誤差逆伝播法(バックプロパゲーション)」を用いて学習する。

- 万能近似定理:隠れ層があれば、どんな複雑な関数(連続関数)でも近似できる能力を持つこと。

ひっかけ対策

- 「線形関数」の罠:

「隠れ層の活性化関数をすべて線形関数(ただの掛け算)にしても、層を増やせば性能は上がる?」 → × 間違い。

線形関数は何回重ねても結局「1つの線形関数」にしかならないため、単純パーセプトロンと性能が変わらなくなります。「非線形関数」が必須です。

📚 より詳細を学びたい方へ