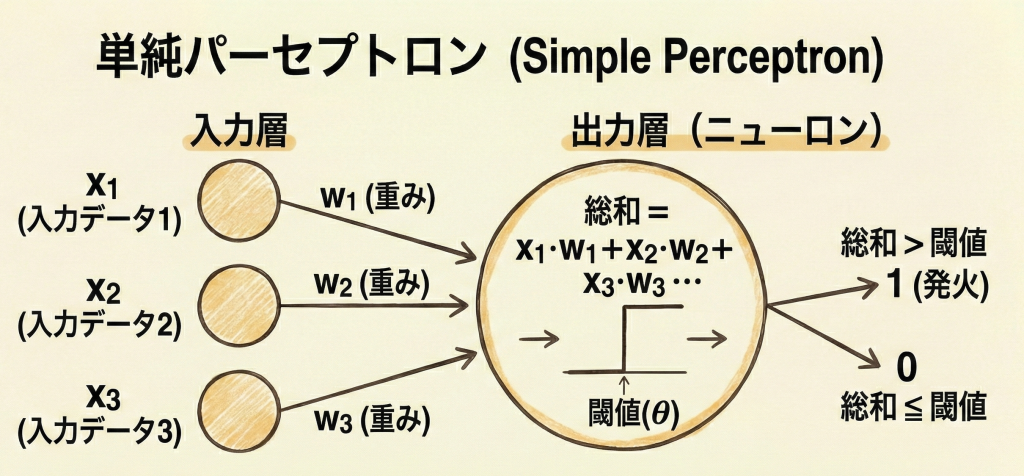

単純パーセプトロン

解説:AIの最もシンプルな形

単純パーセプトロンは、1958年にフランク・ローゼンブラットによって考案された、現在のニューラルネットワークの基礎となるモデルです。

仕組みは非常にシンプルで、「入力層」と「出力層」の2層だけで構成されています。複数の入力データに対して「重み」を掛け合わせ、その合計がある「閾値(しきい値)」を超えたら「1(発火)」、超えなければ「0」を出力します。

最大の特徴:線形分離と「XOR」の壁

単純パーセプトロンには、「直線で引ける境界線(線形分離)」しか学習できないという致命的な弱点があります。

| 論理回路 | 解ける? | 理由(グラフのイメージ) |

|---|---|---|

| ANDゲート ORゲート |

〇 可能 |

「線形分離可能」 白い点と黒い点を、定規一本の直線で綺麗に分けることができる。 |

| XORゲート (排他的論理和) |

× 不可能 |

「非線形分離問題」 点がタスキ掛け(チェス盤のよう)に配置されるため、一本の直線では絶対に分けられない。 |

1969年、ミンスキーとパパートが著書『パーセプトロン』の中で「単純パーセプトロンはXORすら解けない」と数学的に証明しました。これにより、AI研究への期待が一気に冷え込み、第一次AIブームの終焉(冬の時代)を招くことになりました。

G検定対策

出題ポイント

- 構造:「入力層」と「出力層」のみ。(間に隠れ層がない)

- 活性化関数:「ステップ関数(階段関数)」が使われる。

- 限界:「線形分離可能」な問題しか解けない。「XOR(排他的論理和)」は解けない。

- 歴史:ローゼンブラット(考案)→ ミンスキーとパパート(限界の指摘・冬の時代へ)。

ひっかけ対策

- × 単純パーセプトロンでも層を増やせばXORを解ける

(解説)単に層を重ねるだけでは線形のままです。「多層パーセプトロン」にし、かつ「非線形の活性化関数(シグモイド関数など)」を導入することで初めてXORが解けるようになります。 - × 隠れ層を持つ

(解説)単純パーセプトロンには隠れ層(中間層)はありません。

📚 より詳細を学びたい方へ