多クラス分類(Multi-class Classification)

1. 解説

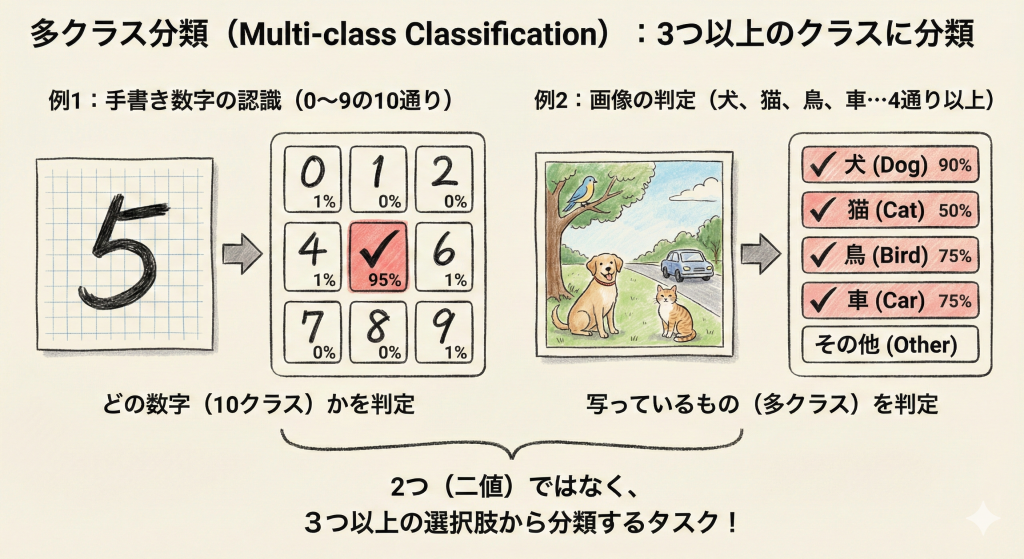

多クラス分類とは、データを「AかBか」の2つではなく、3つ以上のクラス(カテゴリ)に分類するタスクのことです。

例えば、「手書き数字(0〜9の10通り)の認識」や、「画像に写っているのが犬か、猫か、鳥か、車か(4通り以上)の判定」などがこれにあたります。機械学習の現場では、二値分類と並んで非常に頻繁に使われるタスクです。

最重要:「クラスタリング」との違い

G検定では、「多クラス分類(教師あり)」と「クラスタリング(教師なし)」の違いが頻出です。どちらも「データをグループ分けする」点は同じですが、仕組みは全く異なります。

| 項目 | 多クラス分類 | クラスタリング |

|---|---|---|

| 学習タイプ | 教師あり学習 | 教師なし学習 |

| 正解ラベル | ある 「これは犬」「これは猫」と人間が教える。 |

ない データの特徴だけで勝手に分ける。 |

| 目的 | 未知のデータを決められたカテゴリに分類する。 | データの似ているグループ(塊)を発見する。 |

| 例え | 郵便番号を見て、決まった都道府県の箱に仕分ける。 | 散らばった石を、なんとなく色や形でグループ分けする。 |

多クラス分類を実現する2つのアプローチ

実は「3つ以上の分類」は計算が難しいため、以下のいずれかの方法で実現します。

- ① そのまま多クラスを扱えるモデルを使う:

決定木、ランダムフォレスト、ニューラルネットワーク(出力層にソフトマックス関数を使用)など。 - ② 二値分類(AかBか)を組み合わせる:

「Aかそれ以外か」のような二択問題をたくさん作って解決する手法です。サポートベクターマシン(SVM)やロジスティック回帰で使われます。- One-vs-Rest(OvR):「クラスA」対「それ以外」の勝負をクラス数ぶん行う。

- One-vs-One(OvO):「クラスA」対「クラスB」のような総当たり戦を行う。

2. G検定対策

出題ポイント

- 定義:3つ以上のクラスに分類する「教師あり学習」である点。

- ソフトマックス関数:ニューラルネットワークで多クラス分類を行う場合、出力層の活性化関数には、出力の合計が1(100%)になる「ソフトマックス関数」が使われる。

- One-vs-Rest:本来「二値分類」しかできないモデルを多クラスに対応させるための戦略。

ひっかけ対策・注意点

- × クラスタリングと同じである

(解説)ラベル(正解)があるかどうかが決定的な違いです。「メールのフォルダ分け(重要/迷惑/仕事)」のように分類先が決まっているなら多クラス分類です。 - 用語の混同:

「マルチラベル分類」という言葉もあります。これは「1つの画像に犬と猫の両方が写っている」ように、1つのデータに複数の正解タグがつくタスクです。通常の多クラス分類(正解はどれか1つ)とは区別しましょう。

📚 より詳細を学びたい方へ