次元の呪い (The Curse of Dimensionality)

解説

次元の呪いとは、1957年に数学者のリチャード・ベルマン(Richard Bellman)が動的計画法の文脈で提唱した言葉で、データの次元数(特徴量の数)が増えるにつれて、計算量が爆発的に増えたり、学習に必要なデータ量が指数関数的に増加したりする現象を指します。

空間が「スカスカ」になる(スパース性)

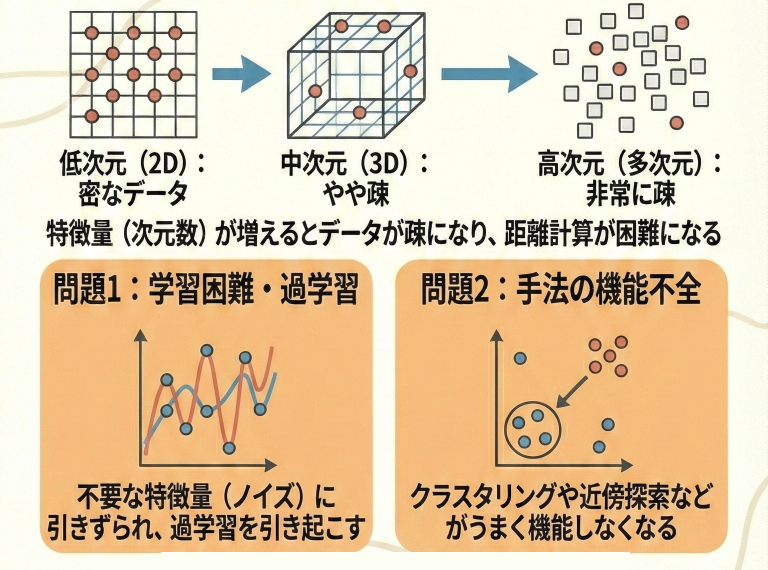

例えば、データを1次元(線)から2次元(面)、3次元(立体)へと増やしていくと、その空間を埋めるために必要な点の数は急激に増えます。

逆に言えば、データの数が同じまま次元だけを増やすと、空間内におけるデータの密度は極端に低くなり、データが散らばって「スパース(疎)」な状態になります。

距離が意味を持たなくなる

高次元空間では、どのデータ点同士の距離もほとんど変わらなくなる「距離の集中現象」が発生します。これにより、ユークリッド距離などを基準にするアルゴリズム(k近傍法やクラスタリングなど)がうまく機能しなくなり、予測精度が著しく低下します。

G検定対策

出題ポイント

- 提唱者:リチャード・ベルマン(Richard Bellman)。動的計画法の考案者としても有名。

- 現象:次元が増えると、空間の体積が指数関数的に増大し、データが疎(スパース)になる。

- 対策:

- 次元削減:主成分分析(PCA)などで重要な次元だけを残す。

- 特徴選択:L1正則化(Lasso)などで不要な特徴量を削除する。

よくあるひっかけ問題

- × 特徴量を増やせば増やすほど、AIの精度は必ず向上する

(解説)逆です。ある程度までは向上しますが、増やしすぎると「次元の呪い」にかかり、過学習(Overfitting)を起こして精度が下がります。 - × 高次元データでは、データ間の距離が明確になり、分類しやすくなる

(解説)逆です。すべてのデータ間の距離が似通ってしまい、違いを区別するのが難しくなります。

📚 より詳細を学びたい方へ