ROC曲線・AUC

解説:モデルの「実力」をグラフにする

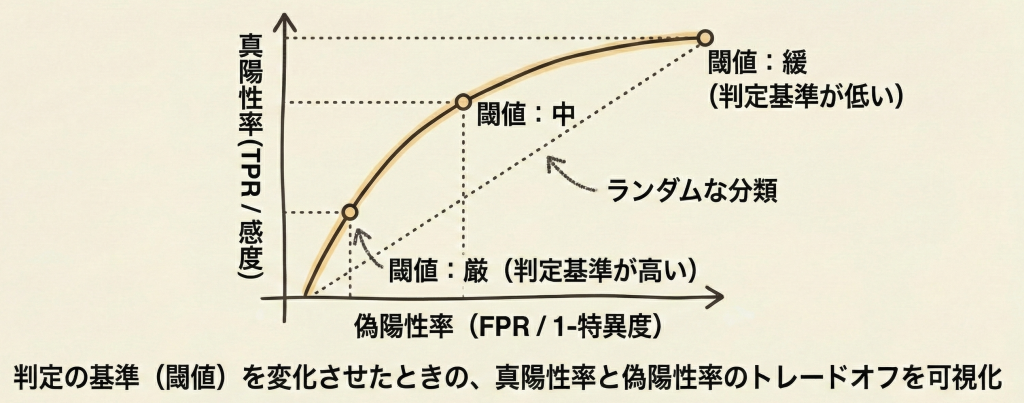

ROC曲線(Receiver Operating Characteristic Curve)は、AIモデル(特に分類モデル)の性能を評価するためのグラフです。特に、「判定の基準(閾値)を厳しくしたり緩めたりしたときに、性能がどう変化するか」を可視化します。

このグラフは、以下の2つの指標を縦軸と横軸にとります。

- 縦軸:真陽性率(TPR / Recall)

「正解データ(陽性)をどれだけ拾えたか」。高いほど良い(上に行くほど優秀)。 - 横軸:偽陽性率(FPR)

「間違い(陰性)をどれだけ誤って拾ってしまったか」。低いほど良い(左に行くほど優秀)。

グラフの線が「左上(誤検知ゼロで、見逃しゼロ)」に近づくほど、理想的なモデルと言えます。

AUC(Area Under the Curve)とは?

ROC曲線の下側の面積をAUC(Area Under the Curve)と呼びます。グラフの形だと比較しにくいため、0から1の数値でスコア化したものです。

| AUCの値 | 評価 |

|---|---|

| 1.0 | 完璧なモデル(すべて正解) |

| 0.8 〜 0.9 | 非常に精度の高いモデル |

| 0.5 | ランダムな予測(コイン投げと同じレベル) |

G検定対策

出題ポイント

- 軸の定義:「縦軸=TPR(真陽性率)」「横軸=FPR(偽陽性率)」の組み合わせを選ぶ問題が頻出です。混同行列の用語と合わせて覚えましょう。

- ランダムな予測:完全にランダムに予測した場合、ROC曲線は「左下から右上への対角線」になり、AUCは0.5になります。

- クラス不均衡への強さ:正解率(Accuracy)に比べると、陽性と陰性のデータ数に偏りがあっても正当に評価しやすい指標です。

ひっかけ対策

- AUCの過信:「AUCが高い=必ずビジネスで使える」とは限りません。陽性データ(病気の人など)が極端に少ない場合、AUCが高く出すぎてしまう性質があるため、その場合はPR曲線(Precision-Recall Curve)を使うこともあります。

- 閾値との関係:ROC曲線は「閾値を0から1まで変化させたときの軌跡」を描いたものです。特定の閾値での一点の性能ではないことに注意してください。

📚 より詳細を学びたい方へ