ニューラルネットワークの正規化(Normalization)手法

解説:データの「乱れ」を整える整流器

ニューラルネットワークの層が深くなると、学習が進むにつれてデータの分布が偏ったりズレたりしてしまい、学習がうまくいかなくなる現象(内部共変量シフト)が起きます。

これを防ぐために、層の途中でデータを強制的に「平均0、分散1」などの扱いやすい範囲に整える処理を正規化(Normalization)と呼びます。

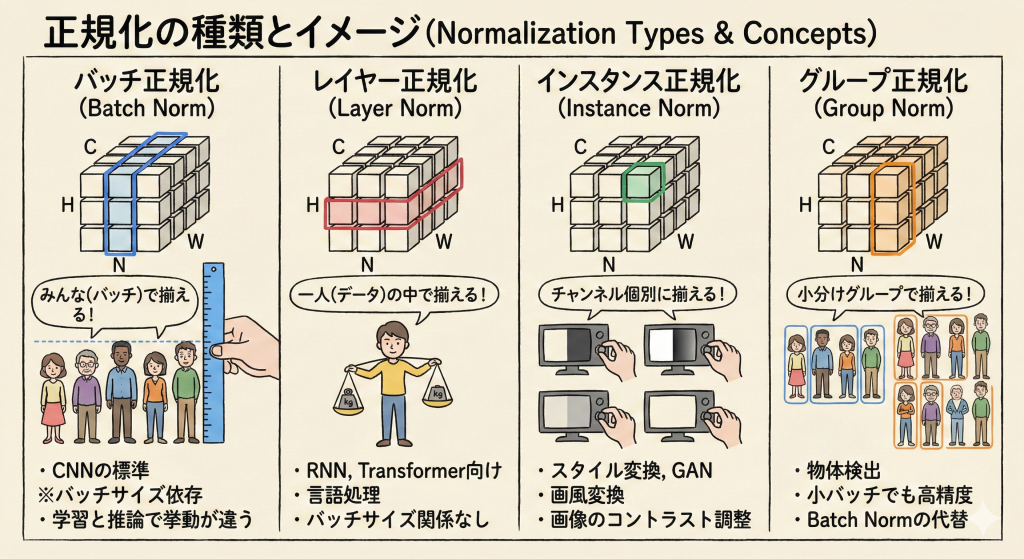

G検定で問われる「4つの正規化」

「何を基準に(どの範囲で)平均をとるか」によって、以下の4つに分類されます。特にバッチ正規化とレイヤー正規化の違いは頻出です。

1. バッチ正規化 (Batch Normalization)

「みんな(バッチ)」で整える手法。

- 仕組み:ミニバッチ内のデータ全体(例:32枚の画像)の平均と分散を使って正規化します。

- 特徴:学習が劇的に安定・高速化し、過学習も抑える効果があります。CNN(画像認識)で標準的に使われます。

- 弱点:バッチサイズが小さい(例:2〜4)と、統計値が不安定になり精度が落ちます。

2. レイヤー正規化 (Layer Normalization)

「個(データ)」の中で整える手法。

- 仕組み:1つのデータの中にある「全チャンネル(特徴量)」の平均と分散を使って正規化します。

- 特徴:「隣のデータ」を気にしないため、バッチサイズが1でも計算可能です。また、学習時と推論時で計算方法を変える必要がありません。

- 主な用途:RNN(時系列データ)、Transformer(自然言語処理)。

※文章の長さがバラバラでも、個別に処理できるため相性が良いです。

3. インスタンス正規化 (Instance Normalization)

「個(各チャンネル)」で独立して整える手法。

- 仕組み:1つのデータの「1つのチャンネル」だけで計算します。最も範囲が狭い正規化です。

- 特徴:画像1枚ごとのコントラスト(画像の明暗や画風)を正規化して打ち消す効果があります。これにより、AIが「色味や画風」ではなく「コンテンツ(形)」に集中しやすくなります。

- 主な用途:スタイル変換(画風変換)、GAN(画像生成)。

4. グループ正規化 (Group Normalization)

「班(グループ)」を作って整える手法。

- 仕組み:チャンネルをいくつかの「グループ(班)」に分け、そのグループ内で計算します。レイヤー正規化とインスタンス正規化の中間のような手法です。

- 特徴:バッチサイズに依存しない安定性を持ちつつ、画像認識においてレイヤー正規化よりも高い精度を出せます。

- 主な用途:物体検出やセグメンテーション。

※これらのタスクは高解像度画像を扱うためメモリを食い、バッチサイズを小さくせざるを得ない(バッチ正規化が使えない)場合が多いため、これが代用されます。

4つの手法の比較まとめ

| 名称 | 計算範囲のイメージ | キーワード・用途 |

|---|---|---|

| バッチ正規化 (Batch Norm) |

縦 (Batch) みんな(バッチ)で揃える |

CNNの標準 ※バッチサイズ依存 学習と推論で挙動が違う |

| レイヤー正規化 (Layer Norm) |

横 (Layer) 一人(データ)の中で揃える |

RNN, Transformer 言語処理向け バッチサイズ関係なし |

| インスタンス正規化 (Instance Norm) |

点 (Channel) チャンネル個別に揃える |

スタイル変換 GAN, 画風変換 画像のコントラスト調整 |

| グループ正規化 (Group Norm) |

班 (Group) 小分けグループで揃える |

物体検出 小バッチでも高精度 Batch Normの代替 |

G検定対策

出題ポイント

- バッチ正規化の弱点:「バッチサイズが小さいと、計算する平均・分散の信頼性が低くなり、精度が落ちる」という点が頻出です。

- タスクとの相性(鉄板パターン):

- 自然言語処理(RNN/Transformer) → レイヤー正規化

- スタイル変換・生成(GAN) → インスタンス正規化

- 物体検出(バッチサイズ小) → グループ正規化

- 学習と推論の違い:バッチ正規化だけは、学習時(その場のバッチ統計量)と推論時(全体の移動平均)で使用する統計量が異なります。他の3つは学習・推論で同じ計算を行います。

ひっかけ対策

- × レイヤー正規化はバッチサイズの影響を強く受ける

(解説)データ個別に計算するので、バッチサイズが1でも計算できます。影響を受けるのはバッチ正規化です。 - × バッチ正規化は推論時も入力データの平均・分散を使って計算する

(解説)推論時には、学習中に蓄積した「移動平均(固定値)」を使います。推論時に入ってくる1枚の画像だけで平均をとると、値が不安定になるためです。