最新の生成・3D技術 (Diffusion / NeRF)

GANに代わって台頭してきた最新の画像生成技術(拡散モデル)と、2D画像から3D空間を構築する技術(NeRF)について解説します。近年のG検定で頻出のトレンド技術です。

1. 拡散モデル (Diffusion Model)

解説:ノイズから「絵」を浮かび上がらせる

拡散モデル(ディフュージョンモデル)は、「Stable Diffusion」や「DALL-E」などの基盤となっている、現在最も主流の画像生成技術です。GANとは全く異なるアプローチをとります。

🌫️ 仕組みのイメージ:霧が晴れるように

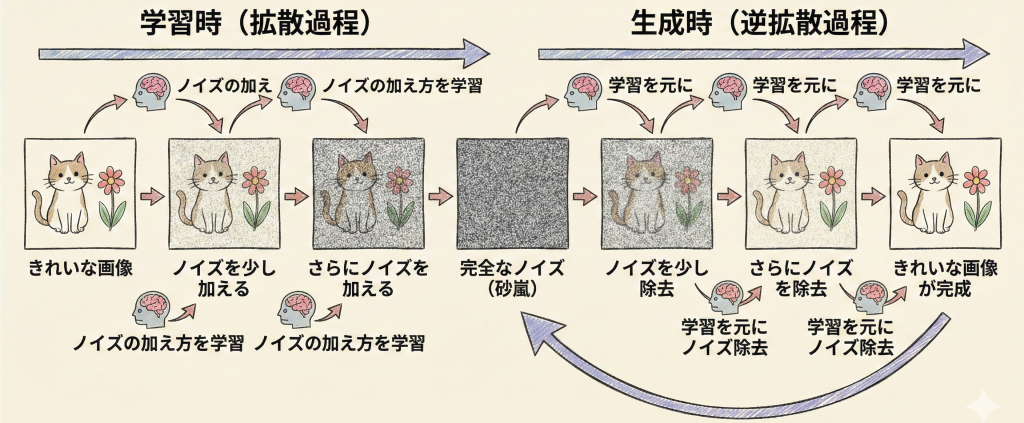

- 拡散過程(学習時):

きれいな画像に、少しずつノイズ(霧)を加えていき、最終的に完全な砂嵐ノイズにします。AIは「どうやってノイズが加えられたか」のパターンを学習します。 - 逆拡散過程(生成時):

完全なノイズの画像からスタートし、学習した知識を使って「ノイズを少しずつ除去」していきます。霧が晴れるように、徐々にきれいな画像が浮かび上がります。

GANとの違い: GANよりも学習が安定しており、生成される画像の多様性が高い(同じような画像ばかりにならない)点が優れています。

2. NeRF (Neural Radiance Fields)

解説:数枚の写真から「3D空間」を再現する

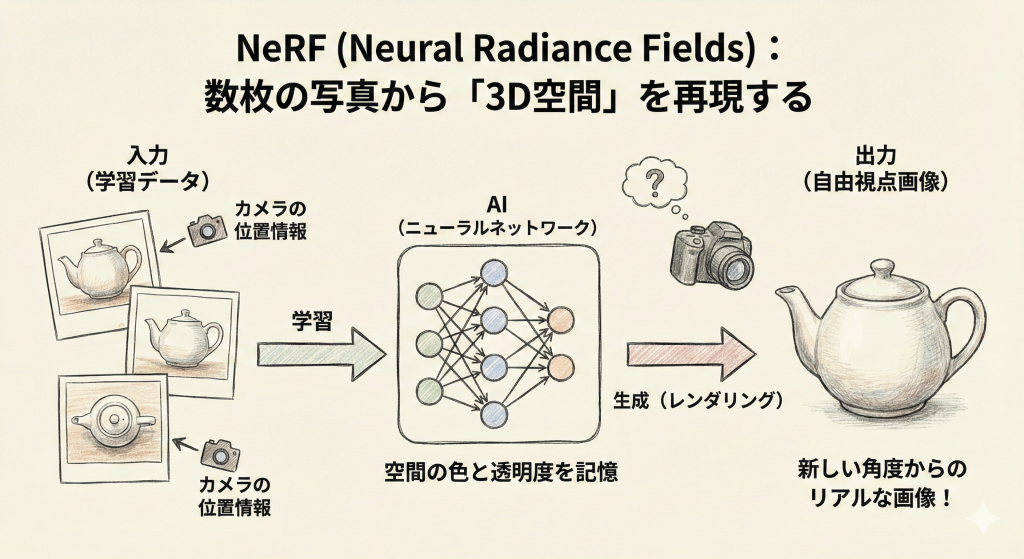

NeRF(ナーフ)は、2Dの画像生成ではなく、3D空間(シーン)そのものをニューラルネットワークで表現する技術です。

ある物体を様々な角度から撮影した「数枚の写真」と「カメラの位置情報」をAIに学習させます。AIは、空間上のあらゆる点の「色」と「透明度(密度)」を記憶します。

学習が完了すると、まだ誰も撮影していない「新しい角度からのリアルな画像(自由視点画像)」を生成(レンダリング)できるようになります。メタバースやVR分野で非常に注目されています。

G検定対策

出題ポイントまとめ

| モデル名 | 仕組みのキーワード | できること |

|---|---|---|

| Diffusion Model | 逆拡散過程 ノイズ除去 |

高品質で多様な画像生成 |

| NeRF | 自由視点画像 輝度場(Radiance Field) |

2D写真から3D空間の構築 |

ひっかけ対策

- × Diffusion ModelはGANの一種である

(解説)全く異なる仕組みのモデルです。 - × NeRFは3Dスキャナを使って形状を取り込む

(解説)NeRFに必要なのは「2Dの写真(画像)」と「カメラ位置」だけです。特別な3Dスキャナは不要です。