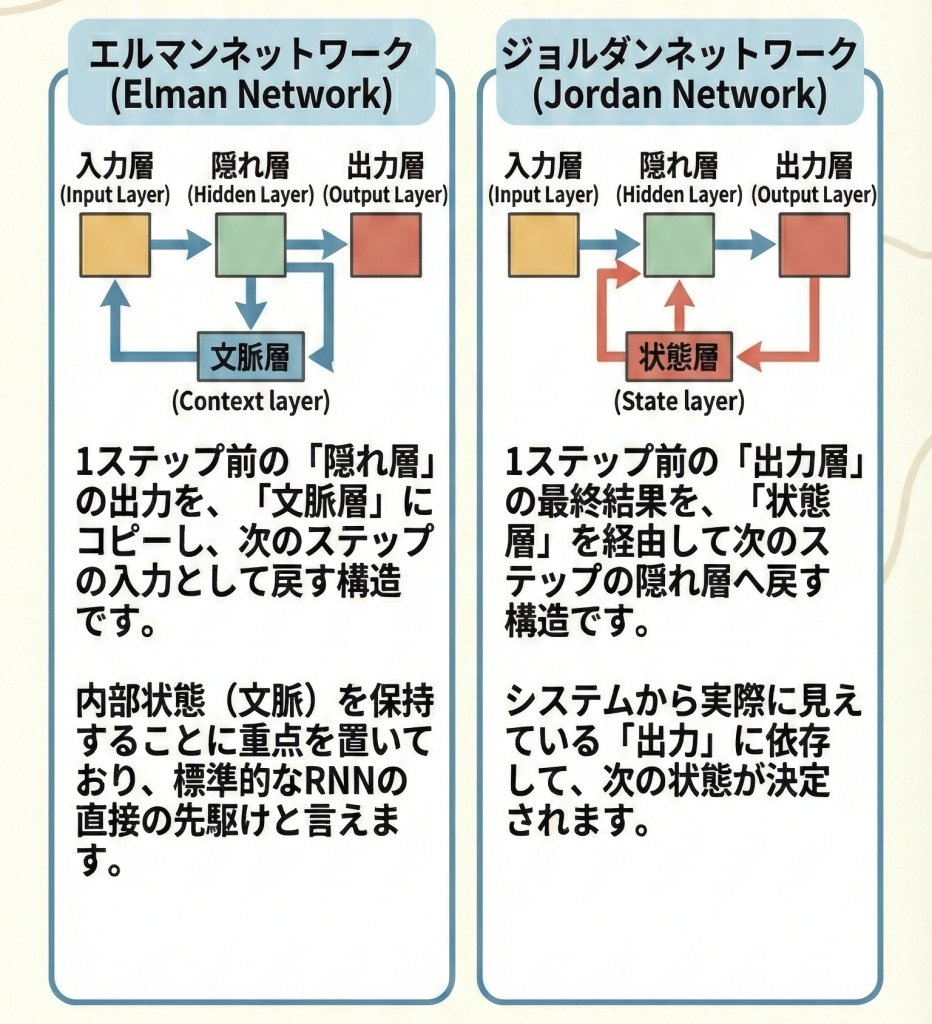

エルマンネット / ジョルダンネット

解説:RNNの「始祖」たち

1990年代初頭に考案された、現代のRNNの原型となるモデルです。それまでのニューラルネットワークは「その瞬間の入力」しか見ることができませんでしたが、これらのモデルは過去の情報を保持する「文脈層(Context Layer)」を導入することで、時系列データの処理を可能にしました。

両者の違いは、「どの情報を『記憶』として次のターンに持ち越すか」です。

1. エルマンネットワーク (Elman Network)

現在の「隠れ層(Hidden Layer)」の状態を、次のステップの入力に戻します。

これは現在の標準的なRNNの構造そのものです。

2. ジョルダンネットワーク (Jordan Network)

現在の「出力層(Output Layer)」の結果を、次のステップの入力に戻します。

「自分が何を出力したか」を記憶するため、ロボットの制御など、出力結果を次の行動に反映させるタスクに適していました。

| モデル名 | フィードバック元 | 現代への系譜 |

|---|---|---|

| エルマンネット | 隠れ層 (Hidden Layer) (内部状態を維持) |

標準的なRNNの原型。 多くの時系列モデルの基礎となった。 |

| ジョルダンネット | 出力層 (Output Layer) (結果をフィードバック) |

制御工学的なアプローチ。 現在の主流ではないが、強化学習的な発想に近い。 |

G検定対策

出題ポイント

- 再帰元の違い:「エルマン=隠れ層」「ジョルダン=出力層」。これさえ覚えておけば解けます。

- 文脈層(Context Layer):過去の情報を一時保存しておく層のこと。この概念が、のちのLSTMの「セル(記憶素子)」へと進化していきました。

ひっかけ対策

- × ジョルダンネットワークは隠れ層からフィードバックする

(解説)それはエルマンです。名前と構造をテレコ(あべこべ)にした選択肢が頻出です。 - × これらは勾配消失問題を解決したモデルである

(解説)これらは初期のモデルであり、勾配消失問題は解決できていません。それを解決したのは、後の「LSTM」です。