早期終了・ノーフリーランチ・二重降下現象

解説:AI学習の「引き際」と「真実」

ここでは、AIの学習をうまくコントロールするための手法と、AIにまつわる不思議な法則を3つ紹介します。

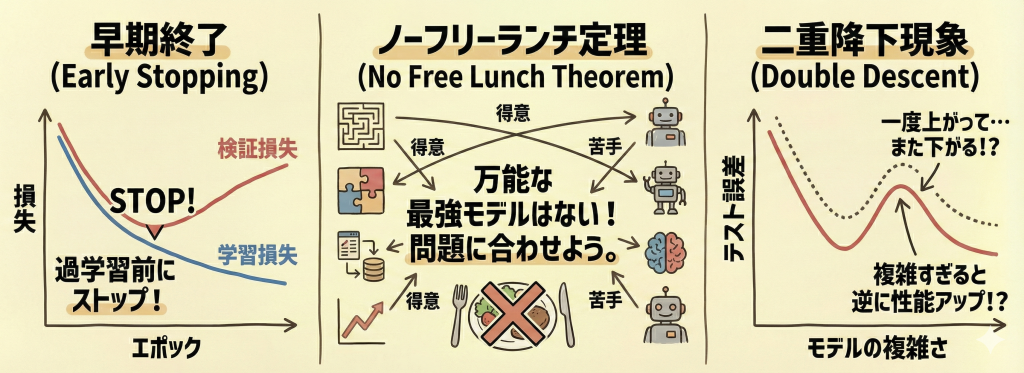

1. 早期終了(アーリーストッピング)

「成績が下がる前に、勝ち逃げする」手法です。

AIは学習を繰り返せば繰り返すほど、「訓練データ(過去問)」の点数は上がり続けます。しかし、ある時点を過ぎると、勉強しすぎて頭が固くなり、「検証データ(模試)」の点数が逆に下がり始めます(過学習)。

そこで、検証データの誤差が悪化し始めた瞬間に、学習を強制ストップさせます。これにより、最も汎用性が高い状態のモデルを確保できます。

2. ノーフリーランチの定理

「どんな料理にも合う最強の調味料は存在しない」という理論です。

「ディープラーニングが最強」と思われがちですが、データが少なくて単純な問題なら「線形回帰」の方が優秀な場合もあります。

数学的に証明された事実は、「あらゆる問題の平均をとれば、どのアルゴリズムも性能は同じ(ランダムと同じ)」ということ。つまり、問題の性質に合わせて、その都度最適な手法を選ぶ必要があります。

3. 二重降下現象(Double Descent)

「過学習のその先に、さらに凄い世界があった」という衝撃的な現象です。

古典的な統計学では「モデルを複雑にしすぎると過学習して性能が落ちる(U字カーブ)」とされてきましたが、最新のディープラーニングでは、「ある境界(補間閾値)を超えてさらにモデルを巨大化させると、再びテスト誤差が下がり始める」という現象が確認されています。

G検定対策

出題ポイント

- 早期終了のトリガー:監視するのは「訓練データ」ではなく「検証データ(Validation Data)」の誤差です。ここが上がったらストップです。

- ノーフリーランチの意味:「万能なアルゴリズムは存在しない」=「対象とする問題に特化した知識(ドメイン知識)や手法選択が重要」という文脈で出ます。

- 二重降下現象の形状:「下がって、上がって、また下がる」という推移。古典的な「バイアス・バリアンスのトレードオフ」と矛盾する現象として問われます。

ひっかけ対策

- × 早期終了は訓練データが0になったら止める

(解説)訓練データが0になるまでやると、大抵は過学習しています。検証データの悪化を見ます。 - × すべての問題においてディープラーニングが最強である

(解説)ノーフリーランチの定理により否定されます。