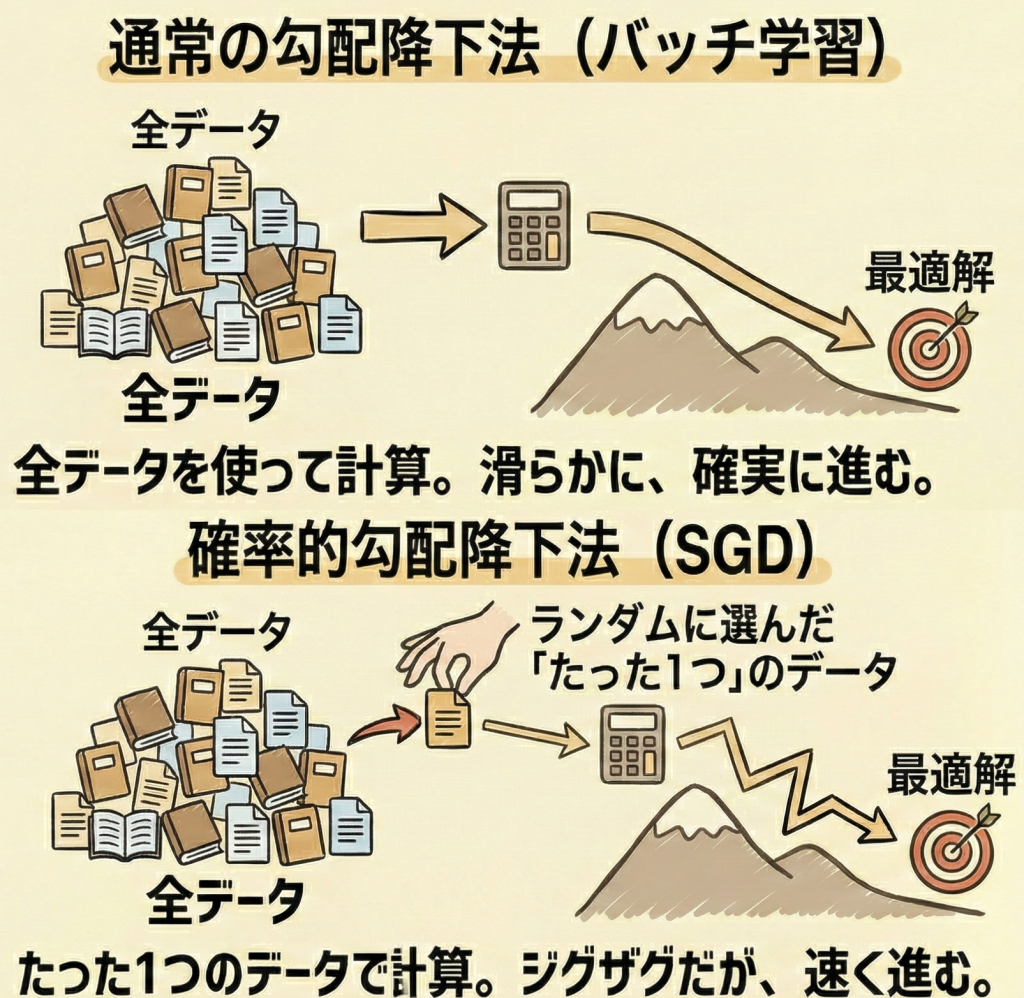

確率的勾配降下法 (SGD)

解説:千鳥足でゴールを目指す

確率的勾配降下法(SGD: Stochastic Gradient Descent)は、勾配降下法の一種ですが、計算に使うデータの量が違います。全データではなく、ランダムに選んだ「たった1つ」のデータだけを使って、パラメータを更新します。

通常の勾配降下法(バッチ学習)が「全員の意見を聞いてから慎重に一歩進む」のに対し、SGDは「通りすがりの一人の意見だけを聞いて、すぐ一歩進む」ようなものです。

なぜ「確率的(Stochastic)」なのか?

データをランダム(確率的)に選ぶため、進む方向が毎回微妙にブレるからです。

そのため、ゴール(最適解)に向かって一直線には進まず、ジグザグと蛇行しながら進みます。

データをランダム(確率的)に選ぶため、進む方向が毎回微妙にブレるからです。

そのため、ゴール(最適解)に向かって一直線には進まず、ジグザグと蛇行しながら進みます。

メリットとデメリットの表裏一体

この「ジグザグな動き」には、良い面と悪い面があります。

| 特徴 | 解説 |

|---|---|

| メリット (局所解の脱出) |

動きがランダムでノイズを含んでいるため、もし「偽物の谷底(局所最適解)」にハマっても、勢いで飛び出せる可能性があります。 また、1回の計算が非常に速く、メモリも少ししか使いません。 |

| デメリット (非効率な経路) |

あっちへフラフラ、こっちへフラフラと進むため、ゴールまでの道のりが遠回りになり、収束(学習完了)までに時間がかかることがあります。 |

※現在では、これらの中間をとった「ミニバッチ学習(数十〜数百個のデータで更新)」が主流ですが、広義にはこれもSGDと呼ばれることが多いです。

G検定対策

出題ポイント

- データの数:「ランダムに選んだ1つ(または少数)のデータ」で更新する手法。

- 軌跡の特徴:最適解に向かって一直線ではなく、ジグザグに進む。

- 利点:計算コストが低いことと、局所最適解(Local Optima)に陥りにくいこと。

ひっかけ対策

- × 全データを使って正確に計算する

(解説)誤りです。それは「バッチ勾配降下法(最急降下法)」の説明です。SGDは「確率的(ランダム)」に一部だけを使います。 - × 常に最短ルートで収束する

(解説)誤りです。ジグザグに進むため、距離的には遠回りになります(非効率)。しかし、それが罠(局所解)を避けるために役立ちます。