ReLU関数(ランプ関数 / 正規化線形関数)

解説:最強の「スイッチ」

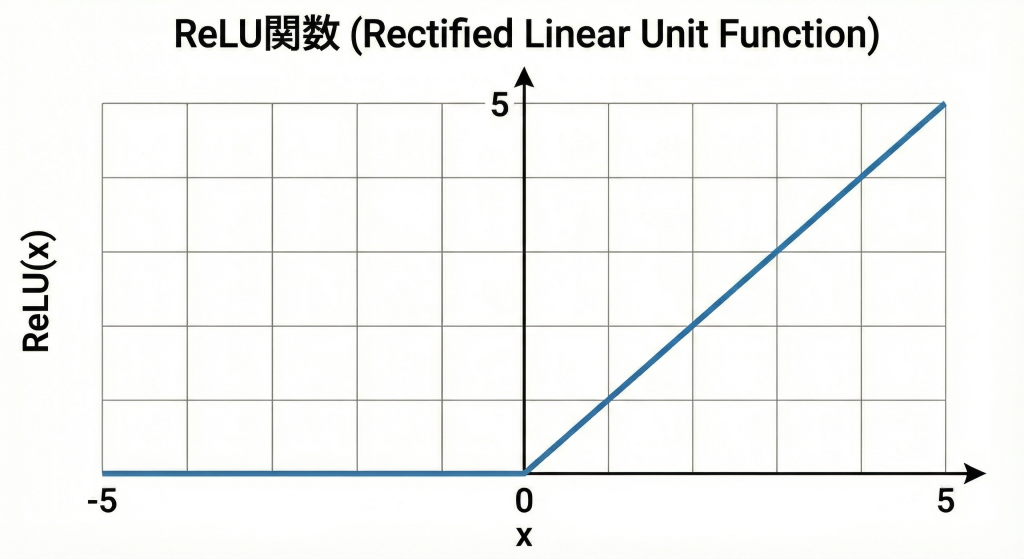

ReLU(Rectified Linear Unit:レル)は、現在ディープラーニングの中間層で最も標準的に使われている活性化関数です。「正規化線形関数」や「ランプ関数」とも呼ばれます。

その仕組みは驚くほどシンプルで、「プラスならそのまま通す、マイナスならゼロにする」という、スイッチのような動きをします。

💡 数式とイメージ

f(x) = max(0, x)

- 入力が正のとき(x > 0):そのまま出力(傾きはずっと1)

- 入力が負のとき(x ≦ 0):完全に0(スイッチOFF)

なぜReLUが「主役」になったのか?

かつての主役だったシグモイド関数を追い落とした理由は、主に2つあります。

| メリット | 理由 |

|---|---|

| 勾配消失に強い | シグモイド関数は端に行くと傾きが0に近づきますが、ReLUは正の領域なら傾きが常に「1」です。 そのため、層をどれだけ深くしても誤差の情報が薄まらず、しっかりと伝わります(勾配消失問題の回避)。 |

| 計算が爆速 | 指数関数(eのx乗など)のような複雑な計算が一切なく、「0と比較するだけ」なので、学習スピードが圧倒的に速くなります。 |

ただし、入力がマイナスになると出力も傾きも「0」になってしまうため、一度その状態になると重みが更新されなくなる「Dead ReLU(ニューロンの死)」という現象が起きることがあります。

G検定対策

出題ポイント

- 挙動の定義:「入力 x > 0 なら x、x ≦ 0 なら 0」という単純なルールを覚える。

- 最大の利点:「勾配消失問題の回避」と「スパース化(無駄なニューロンを0にして計算を軽くする効果)」ができること。

- 別名:問題文によっては「ランプ関数」と呼ばれることもあります。

ひっかけ対策

- 「Leaky ReLU」との混同:

「負の入力のとき、わずかに負の値を出力する(0.01倍するなど)」のはReLUの改良版であるLeaky ReLUです。通常のReLUは完全に「0」になります。 - 「出力層で使う」は△:

ReLUは主に「隠れ層(中間層)」で使われます。出力層(最後の確率出しなど)ではソフトマックス関数などが使われるのが一般的です。