シグモイド関数(Sigmoid Function)

解説:確率への変換装置

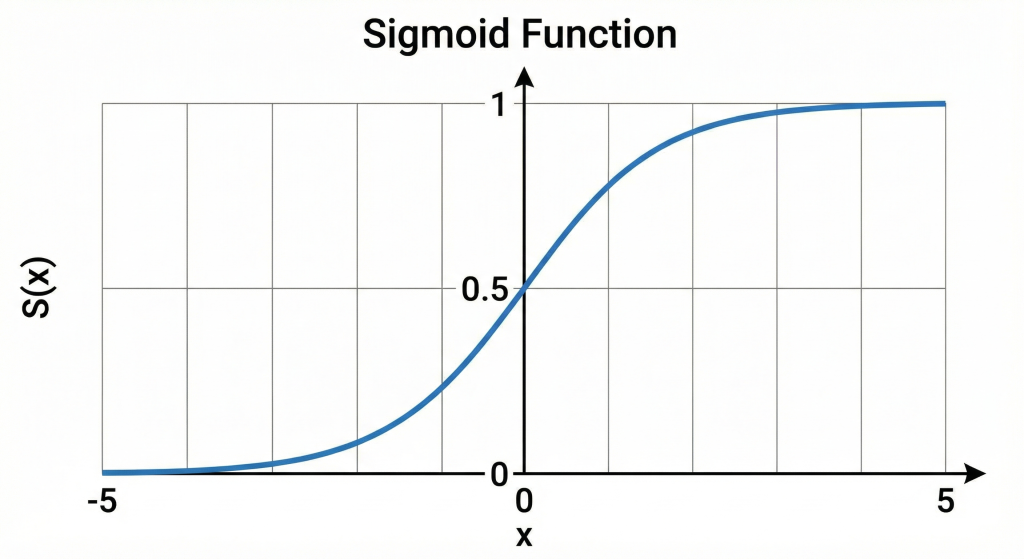

シグモイド関数は、どんな入力値が来ても、出力を必ず「0から1」の範囲にギュッと圧縮する性質を持つS字型の関数です。

この「0〜1」という範囲は、そのまま「確率(0%〜100%)」として解釈できるため、AIが「これは猫である確率:80%(0.8)」といった判定を行う際に非常に便利です。そのため、古くからニューラルネットワークの活性化関数として主役級の扱いを受けてきました。

最大の弱点:「勾配消失問題」

しかし、層を深く重ねるディープラーニングにおいては、「入力が大きすぎたり小さすぎたりすると、学習がストップする」という致命的な欠点があります。

学習が止まる理由(勾配消失)

シグモイド関数のグラフ(上の図)を見てください。

左右の端の方に行くと、カーブがほぼ「平ら(傾きゼロ)」になっています。

AIの学習(誤差逆伝播法)は「坂の傾き」を頼りに進むため、傾きがゼロになると「どっちに進めばいいかわからない」状態になり、学習が完全に停止してしまいます。これが勾配消失問題です。

シグモイド関数のグラフ(上の図)を見てください。

左右の端の方に行くと、カーブがほぼ「平ら(傾きゼロ)」になっています。

AIの学習(誤差逆伝播法)は「坂の傾き」を頼りに進むため、傾きがゼロになると「どっちに進めばいいかわからない」状態になり、学習が完全に停止してしまいます。これが勾配消失問題です。

| 項目 | 特徴 |

|---|---|

| 出力範囲 | 0 〜 1 (確率として扱いやすい) |

| グラフの形状 | 滑らかなS字カーブ。 点 (0, 0.5) を中心とした点対称。 |

| 現在の用途 | 主に「出力層」で使用。 中間層では「勾配消失」を避けるため、ReLU関数を使うのが一般的。 |

G検定対策

出題ポイント

- グラフの中心点:「原点(0, 0)」ではなく、「(0, 0.5)」を通る点対称なグラフであることを覚えておきましょう。

- 主な用途:「二値分類(Yes/No)の出力層」で使われます。

- デメリット:入力の絶対値が大きいと微分値(傾き)が0に近づき、「勾配消失問題」を引き起こすこと。

ひっかけ対策

- × 原点対称である

(解説)原点(0, 0)を中心に対称なのは「tanh関数」です。シグモイドは少し上に浮いています。 - × 中間層に最適である

(解説)かつては使われていましたが、現在はReLU関数の方が推奨されます。「歴史的に使われてきた」という文脈なら正解ですが、「最新の推奨」としては間違いです。