ベイズ情報量規準 (BIC: Bayesian Information Criterion)

解説

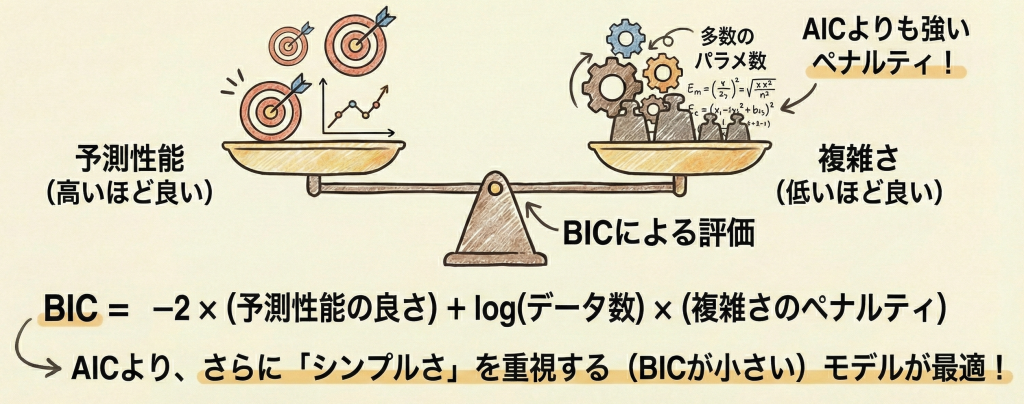

ベイズ情報量規準(BIC)は、AICと同様に「モデルの当てはまりの良さ」と「複雑さ」のバランスを評価する指標ですが、AICよりも「複雑なモデルに対してさらに厳しい」のが特徴です。提案者の名前を取って「シュワルツ情報量規準(SIC)」と呼ばれることもあります。

「もっとシンプルにしなさい!」という頑固親父

AICとBICの性格の違いは、ペナルティ項(複雑さへの罰則)の計算式を見ると一目瞭然です。

| 指標 | 計算式(ペナルティ項に注目) | 性格 |

|---|---|---|

| AIC | −2 ln(L) + 2k | 予測重視。「多少複雑でも、精度が上がるならOK」 |

| BIC | −2 ln(L) + ln(n)k | 構造重視。「本当にその変数必要? データ数が多いならもっと厳しく見るよ」 |

※ k:パラメータ数、n:データ数

データ数が多いほど厳しくなる

BICの式にはデータ数 n が含まれています(ln(n))。

データ数が増えれば増えるほど、パラメータを増やすことへのペナルティが重くなるため、BICはAICに比べて「より不要な変数を削ぎ落とした、シンプルなモデル」を選択する傾向があります(過学習への耐性が強い)。

G検定対策

出題ポイント

- 定義:AICと同様に、値が「小さい(最小)」モデルが良いとされる。

- AICとの違い:

- ペナルティ項にデータ数 n の自然対数 ln(n) を使う。

- AICよりもペナルティが強く働きやすく、変数が少ない(シンプルな)モデルが選ばれやすい。

よくあるひっかけ問題

- × データ数が非常に多い場合、AICよりもBICの方が複雑なモデルを選びやすい

(解説)逆です。データ数 n が増えると ln(n) も大きくなるため、ペナルティが巨大になり、BICは余計な変数を徹底的に排除しようとします(よりシンプルになります)。 - × BICが大きいほど良いモデルである

(解説)AICもBICも「情報の損失(悪さ)」のような指標なので、値は小さいほうが優秀です。