ディープラーニング(Deep Learning)

1. 解説

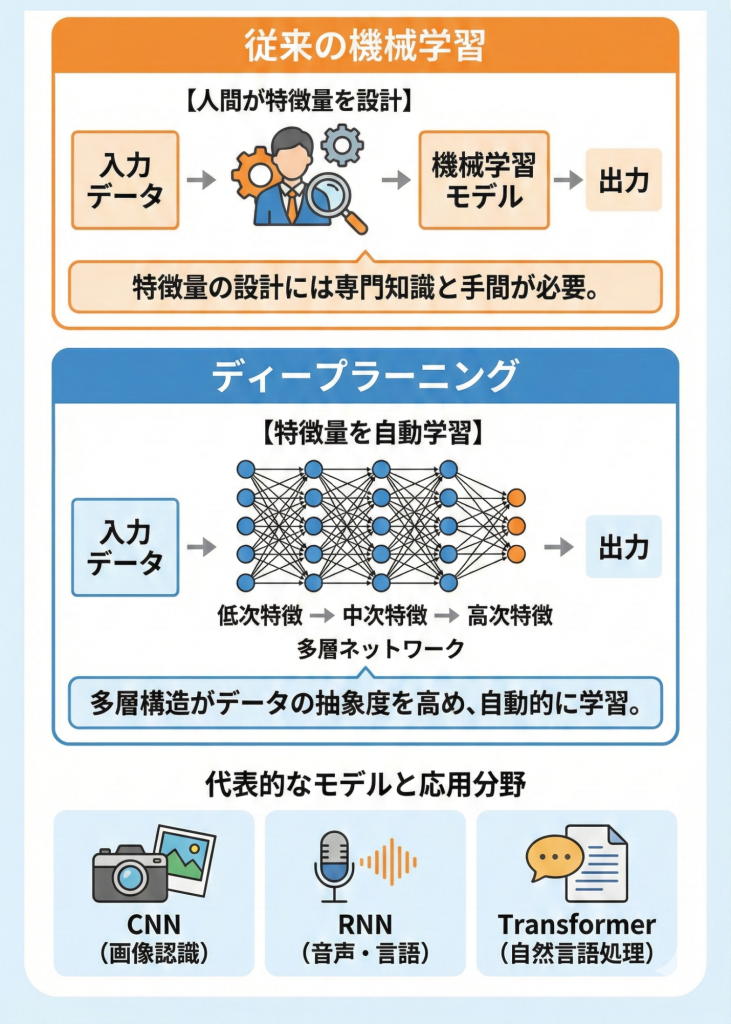

ディープラーニング(深層学習)とは、人間の脳の神経回路を模した「ニューラルネットワーク」を多層に重ねることで、データに含まれる複雑なパターンや特徴を学習する機械学習の一手法です。

最大の特徴は、データから「どこに注目すべきか(特徴量)」をAI自身が自動で学習する点にあります。これを専門用語で「表現学習(Representation Learning)」と呼び、これが第3次AIブームを引き起こした核心的な技術革新です。

従来の機械学習との決定的な違い

G検定では「特徴量の扱い」の違いが最重要ポイントです。

| 比較項目 | 従来の機械学習 | ディープラーニング |

|---|---|---|

| 特徴量の抽出 | 人間が設計する (特徴量エンジニアリング) 例:「猫の耳の形」に着目させる |

AIが自動で獲得する (表現学習) 例:画像データから「耳」や「目」の特徴を自力で見つける |

| 構造 | 比較的シンプル | 多層構造(ディープ) 入力層・隠れ層(多数)・出力層 |

| 必要なデータ量 | 比較的少なくて済む場合がある | 大量のデータが必要 計算コストも高い(GPUが必要) |

代表的なモデル(アルゴリズム)

扱うデータの種類によって、得意なネットワーク構造が異なります。

- CNN(畳み込みニューラルネットワーク):

画像認識が得意。「畳み込み層」と「プーリング層」を用いて画像の特徴を抽出します。 - RNN(再帰型ニューラルネットワーク):

時系列データ(音声、自然言語、株価など)が得意。過去の情報を記憶しながら処理します。 - Transformer(トランスフォーマー):

RNNの弱点を克服し、自然言語処理(翻訳や生成AI)で圧倒的な性能を発揮する最新モデル。「Attention機構」が鍵。

2. G検定対策

出題ポイント

- 用語の定義:「ディープラーニング = 機械学習の一部 = AIの一部」という包含関係。

- 表現学習(Representation Learning):データから特徴表現を自動的に学習すること。これがディープラーニングの本質です。

- DNN(Deep Neural Network):隠れ層(中間層)を2層以上重ねた多層のニューラルネットワークの総称。

ひっかけ対策・注意点

- ブラックボックス問題:

特徴量を自動で学習するため、「なぜその答えになったのか」を人間が解釈・説明するのが難しいという課題(解釈性・説明可能性(XAI)の欠如)があります。 - 過学習(Overfitting):

層を深くしすぎたり、学習させすぎたりすると、訓練データのみに適合してしまい、未知のデータに対応できなくなる現象が起こりやすくなります。 - 「層が深ければ深いほど良い」わけではない:

層が深すぎると学習がうまく進まない問題(勾配消失問題など)が発生するため、適切な調整技術が必要です。