Leaky ReLU関数(リーキー・レル)

解説:ReLUの「弱点」を克服した改良版

Leaky ReLU(LReLU)は、現在主流であるReLU関数の「ある致命的な弱点」を修正するために考案された改良版です。「Leaky」とは「水漏れする」という意味です。

解決したかった問題:「ニューロンの死(Dead ReLU)」

通常のReLUは、入力がマイナスになると出力を容赦なく「0」にします。これは計算を軽くするメリットもありますが、一度「0」になってしまうと勾配(傾き)もなくなってしまい、学習による重みの更新が一切行われなくなる現象が起きることがあります。

これを「Dead ReLU(ニューロンの死)」と呼びます。死んでしまったニューロンは、その後二度と生き返らず、学習に参加できなくなってしまいます。

Leaky ReLUの仕組み

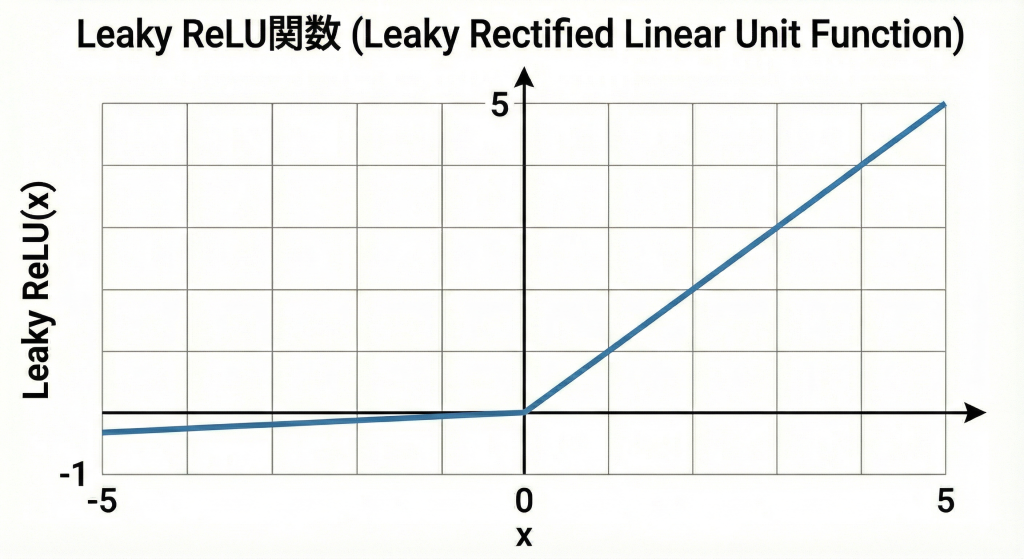

そこで、マイナスの入力に対して「完全に0(遮断)」にするのではなく、「わずかに値を漏らす(傾きを持たせる)」ことにしました。

これにより、マイナスの領域に入っても「死ぬ」ことなく、わずかながら学習(パラメータ更新)を続けることができるようになります。

G検定対策

出題ポイント

- 目的:ReLUの欠点である「Dead ReLU(学習が止まる現象)」を防ぐために作られた。

- 形状:負の領域で、水平(0)ではなく「わずかな傾き」を持っていること。

- 計算コスト:ReLUとほぼ変わらず、シグモイド関数などに比べて非常に高速。

ひっかけ対策

- × 負の領域の傾きは1である

(解説)傾きが「1」だと、単なる直線(y=x)になってしまい、非線形性が失われます。傾きは「0.01」などの微小な値です。

📚 より詳細を学びたい方へ